巴比特 | 元宇宙每日必读

来源:新智元

导读:ChatGPT背后,是微软超级昂贵的超级计算机,耗资数亿美元,用了英伟达数万颗芯片。

ChatGPT能成为如今火遍全球的顶流模型,少不了背后超强的算力。

数据显示,ChatGPT的总算力消耗约为3640PF-days(即假如每秒计算一千万亿次,需要计算3640天)。

那么,作为依托的那台微软专为OpenAI打造的超级计算机,又是如何诞生的呢?

周一,微软在官博上连发两文,亲自解密这台超级昂贵的超级计算机,以及Azure的重磅升级——加入成千上万张英伟达最强的p00显卡以及更快的InfiniBand网络互连技术。

基于此,微软也官宣了最新的ND p00 v5虚拟机,具体规格如下:

数亿美元撑起来的算力

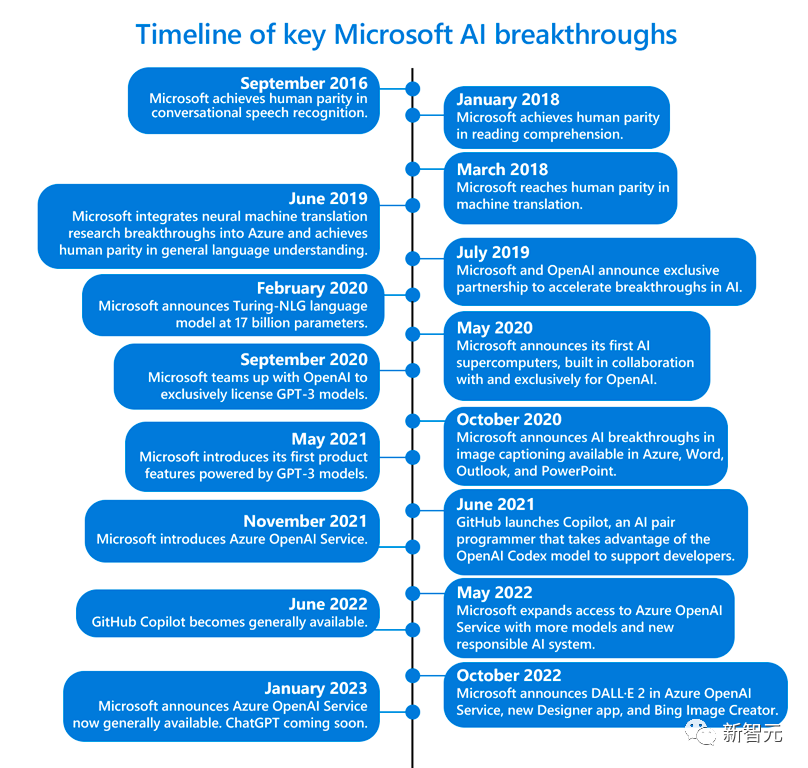

大约五年前,OpenAI向微软提出了一个大胆的想法——建立一个可以永远改变人机交互方式的人工智能系统。

当时,没人能想到,这将意味着AI可以用纯语言创造出人类所描述的任何图片,人类可以用聊天机器人来写诗、写歌词、写论文、写邮件、写菜单……

为了建立这个系统,OpenAI需要很多算力——可以真正支撑起超大规模计算的那种。

但问题是,微软能做到吗?

毕竟,当时既没有能满足OpenAI需要的硬件,也无法确定在Azure云服务中构建这样庞大的超级计算机会不会直接把系统搞崩。

随后,微软便开启了一段艰难的摸索。

微软Azure高性能计算和人工智能产品负责人Nidhi Chappell(左)和微软战略合作伙伴关系高级总监Phil Waymouth(右)

为了构建支持OpenAI项目的超级计算机,它斥资数亿美元,在Azure云计算平台上将几万个Nvidia A100芯片连接在一起,并改造了服务器机架。

此外,为了给OpenAI量身打造这个超算平台,微软十分尽心,一直在密切关注着OpenAI的需求,随时了解他们在训练AI时最关键的需要。

这么一个大工程,成本究竟是多少呢?微软负责云计算和人工智能的执行副总裁Scott Guthrie不愿透露具体数目,但他表示,「可能不止」几亿美元。

OpenAI出的难题

微软负责战略合作伙伴关系的高管Phil Waymouth指出,OpenAI训练模型所需要的云计算基础设施规模,是业内前所未有的。

呈指数级增长的网络GPU集群规模,超过了业内任何人试图构建的程度。

微软之所以下定决心与OpenAI 合作,是因为坚信,这种前所未有的基础设施规模将改变历史,造出全新的AI,和全新的编程平台,为客户提供切实符合他们利益的产品和服务。

现在看来,这几亿美元显然没白花——宝押对了。

在这台超算上,OpenAI能够训练的模型越来越强大,并且解锁了AI工具令人惊叹的功能,几乎开启人类第四次工业革命的ChatGPT,由此诞生。

非常满意的微软,在1月初又向OpenAI狂砸100亿美元。

可以说,微软突破AI超算界限的雄心,已经得到了回报。而这背后体现的,是从实验室研究,到AI产业化的转变。

目前,微软的办公软件帝国已经初具规模。

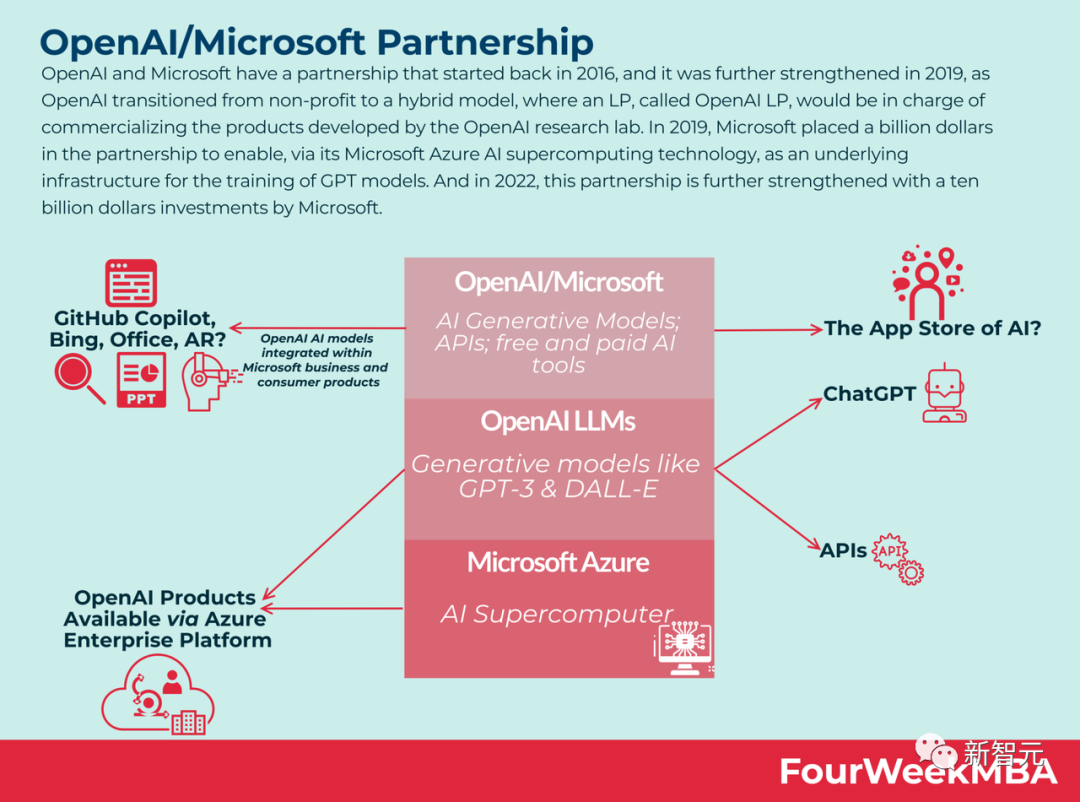

ChatGPT版必应,可以帮我们搜索假期安排;Viva Sales中的聊天机器人可以帮营销人员写邮件;GitHub Copilot可以帮开发者续写代码;Azure OpenAI 服务可以让我们访问OpenAI的大语言模型,还能访问Azure的企业级功能。

和英伟达联手

其实,在去年11月,微软就曾官宣,要与Nvidia联手构建「世界上最强大的AI超级计算机之一」,来处理训练和扩展AI所需的巨大计算负载。

这台超级计算机基于微软的Azure云基础设施,使用了数以万计个Nvidia p00和A100Tensor Core GPU,及其Quantum-2 InfiniBand网络平台。

Nvidia在一份声明中表示,这台超级计算机可用于研究和加速DALL-E和Stable Diffusion等生成式AI模型。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier