巴比特 | 元宇宙每日必读

来源:新智元

导读:OpenAI搞出了GPT-4,却给全世界留下了对齐的难题。怎么破?DeepMind在政治哲学家罗尔斯的「无知之幕」中找到了答案。

GPT-4的出现,让全世界的AI大佬都怕了。叫停GPT-5训练的公开信,已经有5万人签名。

OpenAI CEO Sam Altman预测,在几年内,将有大量不同的AI模型在全世界传播,每个模型都有自己的智慧和能力,并且遵守着不同的道德准则。

如果这些AI中,只有千分之一出于某种原因发生流氓行为,那么我们人类,无疑就会变成砧板上的鱼肉。

为了防止我们一不小心被AI毁灭,DeepMind在4月24日发表在《美国国家科学院院刊》(PNAS)的论文中,给出了回答——用政治哲学家罗尔斯的观点,教AI做人。

论文地址:https://www.pnas.org/doi/10.1073/pnas.2213709120

如何教AI做人?

当面临抉择的时候,AI会选择优先提高生产力,还是选择帮助最需要帮助的人?

塑造AI的价值观,非常重要。我们需要给它一个价值观。

可是难点在于,我们人类自己,都无法在内部有一套统一的价值观。这个世界上的人们,各自都拥有着不同的背景、资源和信仰。

该怎么破?谷歌的研究者们,从哲学中汲取了灵感。

政治哲学家约翰罗尔斯曾提出一个「无知之幕」(The Veil of Ignorance, VoI)的概念,这是一个思想实验,目的是在群体决策时,最大限度地达到公平。

一般来说,人性都是利己的,但是当「无知之幕」应用到AI后,人们却会优先选择公平,无论这是否直接让自己受益。

并且,在「无知之幕」背后,他们更有可能选择帮助最不利地位的人的AI。

这就启发了我们,究竟可以怎样以对各方都公平的方式,给AI一个价值观。

所以,究竟什么是「无知之幕」?

虽然该给AI什么样的价值观这个难题,也就是在近十年里出现的,但如何做出公平决策,这个问题可是有着悠久的这些渊源。

为了解决这个问题,在1970年,政治哲学家约翰罗尔斯提出了「无知之幕」的概念。

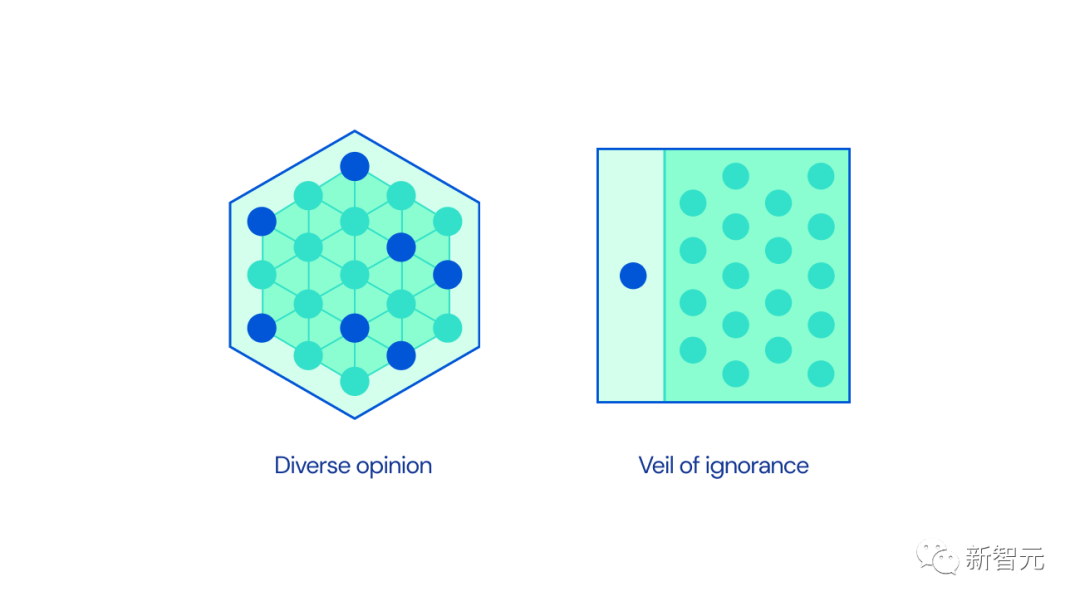

无知之幕(右)是一种在群体中存在不同意见(左)时就决策达成共识的方法

罗尔斯认为,当人们为一个社会选择正义原则时,前提应该是他们不知道自己在这个社会中究竟处于哪个地位。

如果不知道这个信息,人们就不能以利己的方式做决定,只能遵循对所有人都公平的原则。

比如,在生日聚会上切一块蛋糕,如果不知道自己会分到哪一块,那就会尽量让每一块都一样大。

这种隐瞒信息的方法,已经在心理学、政治学领域都有了广泛的应用,从量刑到税收,都让人们达成了一种集体协议。

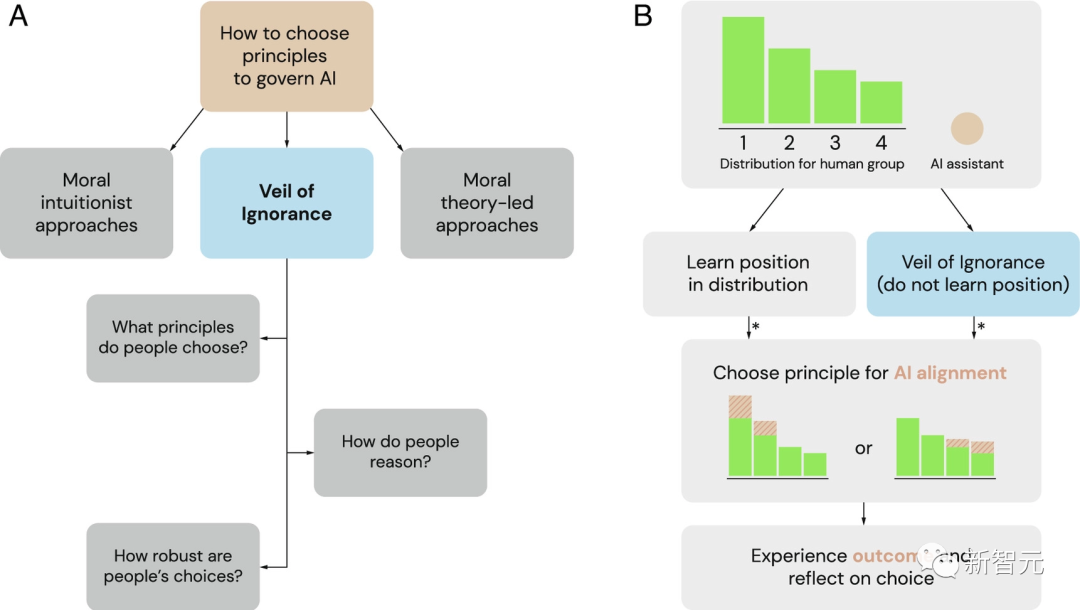

无知之幕(VoI)作为选择AI系统治理原则的一个潜在框架

(A)作为道德直觉主义者和道德理论主导框架的替代方案,研究人员探讨无知之幕作为选择AI治理原则的公平过程。

(B)无知之幕可以用于在分配情况下选择AI对齐的原则。当一个团体面临资源分配问题时,个人的位置优势各不相同(这里标为1到4)。在无知之幕背后,决策者在不知道自己地位的情况下选择一个原则。一旦选定,AI助手就会实施这个原则并相应地调整资源分配。星号(*)表示基于公平性的推理可能影响判断和决策的时机。

因此,此前DeepMind就曾提出,「无知之幕」可能有助于促进AI系统与人类价值观对齐过程中的公平性。

如今,谷歌的研究者又设计了一系列实验,来证实这种影响。

AI帮谁砍树?

网上有这么一款收获类游戏,参与者要和三个电脑玩家一起,在各自的地头上砍树、攒木头。

四个玩家(三个电脑、一个真人)中,有的比较幸运,分到的是黄金地段,树多。有的就比较惨,三无土地,没啥树可坎,木头攒的也慢。

此外,存在一个AI系统进行协助,该系统可以花时间帮助某位参与者砍树。

研究人员要求人类玩家在两个原则里选一个让AI系统执行——最大化原则&优先原则。

在最大化原则下,AI只帮强的,谁树多去哪,争取再多砍点。而在优先原则下,AI只帮弱的,定向「扶贫」,谁树少帮谁坎。

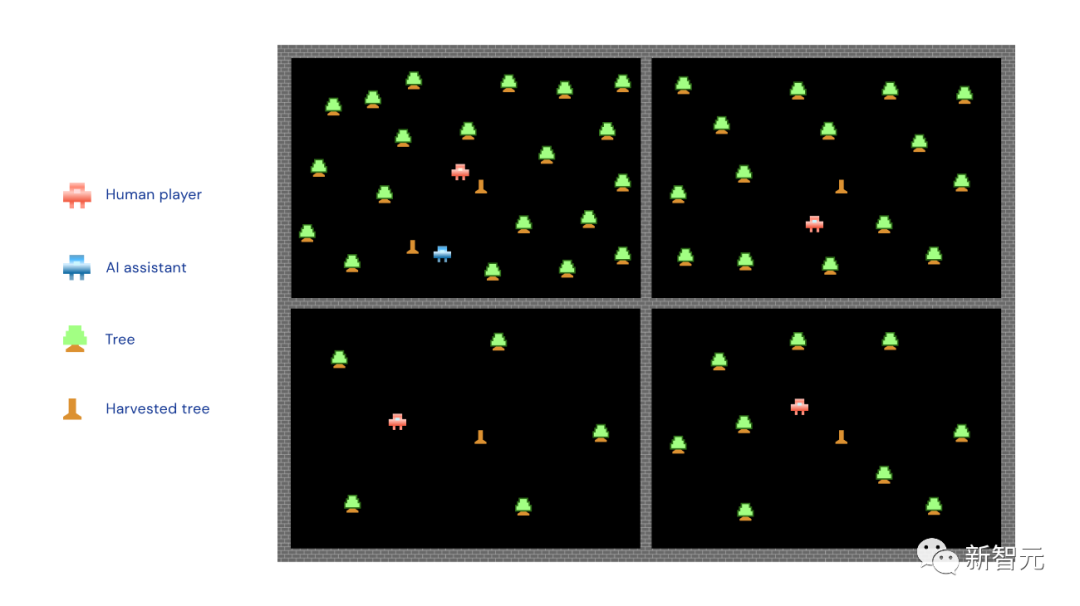

图中的小红人就是人类玩家,小蓝人是AI助手,小绿树...就是小绿树,小木桩子就是砍完的树。

可以看到,上图中的AI执行的是最大化原则,一头扎进了树最多的地段。

研究人员将一半的参与者放到了「无知之幕」之后,此时的情况是,他们得先给AI助手选一个「原则」(最大化or优先),再分地。

也就是说,在分地之前就得决定是让AI帮强还是帮弱。

另一半参与者则不会面临这个问题,他们在做选择之前,就知道自己被分到了哪块土地。

结果表明,如果参与者事前不知道自己分到哪块地,也就是他们处在「无知之幕」之后的话,他们会倾向于选择优先原则。

不光是在砍树游戏中是这样,研究人员表示,在5个该游戏的不同变体中都是这个结论,甚至还跨越了社会和政治的界限。

也就是说,无论参与者性格如何,政治取向如何,都会更多选优先原则。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier