三大巨头联合署名!又一

又一封“群星云集”警示AI风险的公开信来了,这封信的内容简短但措辞炸裂:减轻 AI 带来的灭绝风险,应该与管控流行病和核战争等其他社会级规模的风险一样,成为一项全球优先事项。

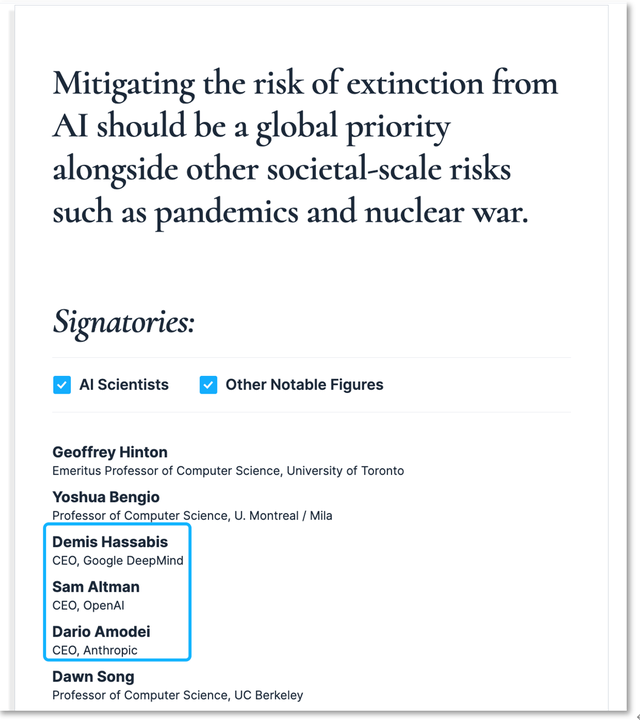

5月30日,这纸原文只有22个单词的声明,出现在美国非营利组织“人工智能安全中心(Center for AI Safety)”的官网上,超过350名AI领域的企业界和学界名流为之签名。

与2个半月前“生命未来研究所”发出的、上千名人签名呼吁“暂停训练大模型6个月”的那封公开信相比,最令人瞩目的是,这次,OpenAI、谷歌DeepMind 和 Anthropic的CEO都签了名。

值得注意的是,在签署“22字声明”前,OpenAI、谷歌、Anthropic三家公司的负责人都出席了5月4日白宫发起的AI风险治理会议。面对风险管理,AI三巨头近段时间显得比政府还着急。

最近,这三家公司CEO频繁地与欧洲多国首脑会晤,试图影响正在推进中的欧盟《人工智能法案》,这项法案很可能影响OpenAI等公司的生成式大模型进入欧洲市场,而那里是流量新神话缔造者OpenAI都暂未拿下的“处女地”。

求管控AI风险的背后,是AI公司们满满的市场“求生欲”。

三巨头留名最新AI风险声明

“Mitigating the risk of extinction from AI should be a global priority alongside other societal-scale risks such as pandemics and nuclear war.”

22个单词组成了一纸《人工智能风险声明》,将AI带来的风险直接以“灭绝(extinction)”措辞,严重程度堪比“流行病(pandemics)”和“核战争(nuclear war)”,管控紧迫度被表述为“应该成为全球优先事项”。

5月30日,在非营利组织“人工智能安全中心(Center for AI Safety)”官网晒出的这纸声明下,有包括科学家、企业领导人在内的350多人签了自己的名字。

AI三巨头的CEO的名字出现在名单中

“我们必须让这个问题上公开化,因为许多人只在彼此之间默默地交谈。”人工智能安全中心的执行主任丹·亨德里克斯(Dan Hendrycks)在谈到声明的目的时表示,一句话声明的简明扼要是特意为之,目的是让更多的科学家建立“广泛联盟”,因为一些科学家可能还没有就AI有哪些风险以及预防风险的最佳解决方案达成一致。

350个签名中,打头的两位是图灵奖得主杰弗里·辛顿 (Geoffrey Hinton)和约书亚·本希奥(Youshua Bengio),紧跟着出现了戴米斯·哈萨比斯(Demis Hassabis)、山姆·奥特曼(Sam Altman)和达里奥·阿莫迪(Dario Amodei)三位,他们分别为谷歌DeepMind、OpenAI和Anthropic三家全球知名人工智能开发公司的CEO。

一些中国知名学者也签了名,如清华大学智能产业研究院院长张亚勤、中科院自动化研究所的曾毅教授、清华智能产业研究院的副教授詹仙园。

如果把“用知识服务人类”视作知识分子的社会责任,专家、学者的签名很好理解,被誉为“AI教父”的辛顿今年4月从谷歌辞职,此后一直在公开场域表达对人工智能失控的担忧;本希奥曾在今年3月非营利组织“未来生命研究所(Future of Life Institute)”发表的那一封“暂停巨型AI实验”公开信上签过字。

但在2个月前的那封信上,谷歌DeepMind、OpenAI和Anthropic这三家公司的负责人并没有签名,相比这次的“22字声明”,那封信还详细阐述了AI可能带来的各种具体风险,甚至给出了明确的风险管理原则,至今已积累收集到31810个签名。

上次那封信引发的AI圈内的明显分歧是:到底应不应该为了风险而暂停AI实验。

当时,人工智能领域的学者吴恩达当时在LinkedIn上表示,全面暂停AI训练6个月的想法是一个糟糕、不切实际的想法。后来,OpenAI CEO山姆·奥特曼Sam Altman更直观地表达了暂停的无意义,“我们暂停6个月,然后呢?我们再暂停6个月?”

但这次,AI企业三巨头领导者带头签了这个风险阐述模糊但措辞严峻的“22字声明”从他们表态对声明的认同中,透露出管控AI风险的紧迫性。

短短的两个月半内,是什么致使AI公司们都转变了态度?

OpenAI访问量增速放缓

现在,人类即便没有被AI灭绝,但生成式AI在作恶者的驱使下露出了“黑暗面”。

比如,AI的仿声仿貌功能正在被用作诈骗工具,AI生成图片、文字的能力不仅被用来造假新闻,造出的“黄谣”直接伤害到普通个体的声誉。

相比生成式AI对常识“胡说八道”、会陷入逻辑陷阱、解数学题不太行、数据隐私安全等缺陷,受害案例显示出的AI破坏力更具体、更直观地呈现在公众眼前。对AI开发公司来说,最直接的影响是那些刚刚开放AI应用给公众的开发公司,还能在负面舆论中的获得多少增量市场?

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier