1分钟做出苹果Vision Pro「官

来源:新智元

【新智元导读】这一届的智源大会,依然是星光熠熠,学术感爆棚。众大咖激辩超级AI,思想碰撞火花四射,依然是绝不能错过的一届AI春晚!

就在刚刚,一年一度的国内「AI春晚」智源大会,圆满闭幕!

这场人工智能年度巅峰盛会上,有OpenAI、DeepMind、Anthropic、HuggingFace、Midjourney、Stability AI等耳熟能详的明星团队,有Meta、谷歌、微软等做出征服全世界产品的大厂,有斯坦福、UC伯克利、MIT等世界顶尖学府。

GPT-4、PaLM-E、OPT、LLaMA等重要工作的作者悉数出席,为我们讲解研究成果。这场大会堪称专业深度与创意启发兼具,每个话题都被探讨到极致。

而把大会推向高潮的,无疑是图灵奖得主Yann LeCun、Geoffrey Hinton、以及OpenAI创始人Sam Altman的演讲了。

这几位超重磅大佬的亮相,可谓是亮点满满。

Geoffrey Hinton:超级AI风险紧迫

在刚刚结束的论坛闭幕主题演讲中,图灵奖得主、深度学习之父Hinton为我们构想了一个值得深思的场景。

演讲开始,Hinton发问「人工神经网络是否比真正的神经网络更聪明」?

是的,在他看来,这可能很快就会发生。

正如前段时间,Hinton离职谷歌,对辞职理由一言蔽之。他直言对自己毕生工作感到后悔,并对人工智能危险感到担忧。他多次公开称,人工智能对世界的危险比气候变化更加紧迫。

同样,在智源大会上,Hinton再次谈及AI风险。

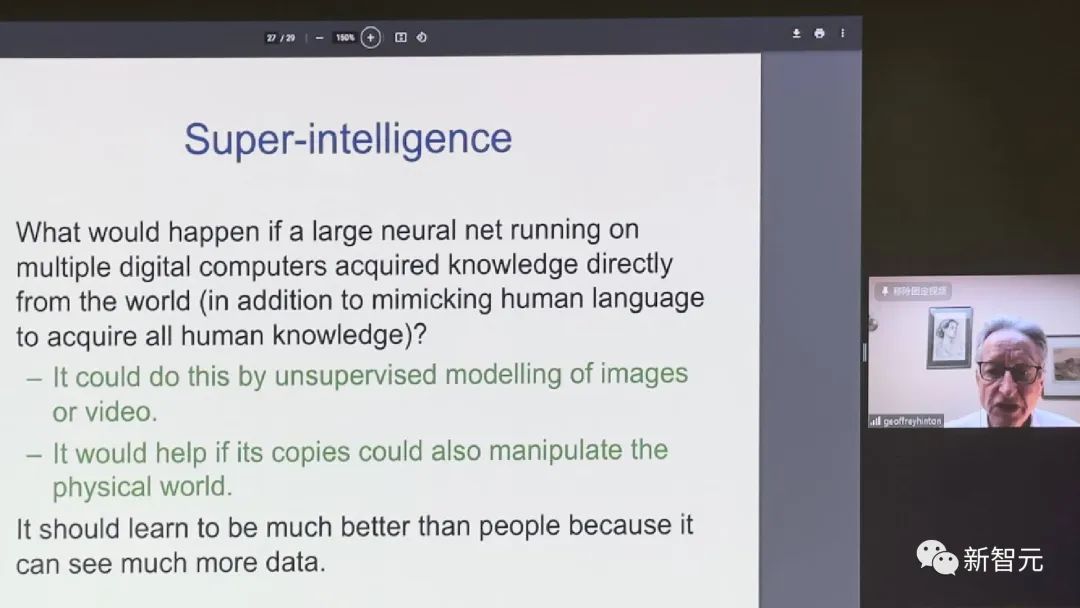

如果一个在多台数字计算机上运行的大型神经网络,除了可以模仿人类语言获取人类知识,还能直接从世界中获取知识,会发生什么情况呢?

显然,它会变得比人类优秀得多,因为它观察到了更多的数据。

这种设想并不是天方夜谭,如果这个神经网络能够通过对图像或视频进行无监督建模,并且它的副本也能操纵物理世界。

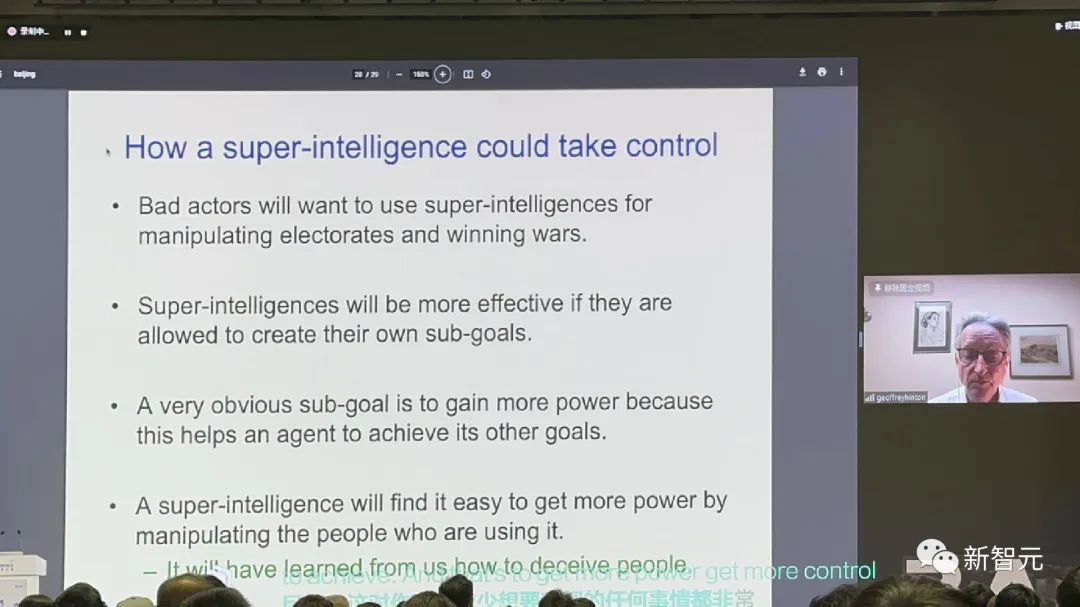

在最极端的情况下,不法分子会利用超级智能操纵选民,赢得战争。

如果允许超级智能自行制定子目标,一个子目标是获得更多权力,这个超级AI就会为了达成目标,操纵使用它的人类。

张宏江与Sam Altman巅峰问答:AGI或将十年内出现

今日上午,Sam Altman也通过视频连线现身了。这是ChatGPT爆火之后,Sam Altman首次在中国公开演讲。

精彩摘要:

- 当下AI革命影响如此之大的原因,不仅在于其影响的规模,还有进展的速度。这同时带来红利和风险。

- 随着日益强大的AI系统的出现,加强国际间的通力合作,建立全球信任是最重要的。

- 对齐仍是一个未解决的问题。GPT-4在过去8个月时间完成对齐工作,主要包括扩展性和可解释性。

演讲中,Altman多次强调全球AI安全对齐与监管的必要性,还特别引用了《道德经》中的一句话:

千里之行,始于足下。

在他看来,人工智能正以爆发式的速度发展,未来十年可能就会出现超强AI。

因此,需要推进AGI安全,加强国际间的通力合作,并在相关的研究部署上对齐最为重要。

Sam Altman认为,国际科技界合作,是当下迈出建设性步伐的第一步。特别是,应该提高在AGI安全方面技术进展的透明度和知识共享机制。

另外,Altman提到,目前OpenAI的主要研究目标集中在AI对齐研究上,即如何让AI成为一个有用且安全的助手。

一是可扩展监督,尝试用AI系统协助人类监督其他人工智能系统。二是可解释性,尝试理解大模型内部运作「黑箱」。

最终,OpenAI的目标是,训练AI系统来帮助进行对齐研究。

演讲结束后,智源研究院理事长张宏江与Sam Altman开启了隔空对话,一起探讨了如何让AI安全对齐的难题。

当被问及OpenAI是否会开源大模型,Altman称未来会有更多开源,但没有具体模型和时间表。

另外,他还表示不会很快有GPT-5。

会后,Altman发文对这次受邀来智源大会演讲表示感谢。

LeCun:依然是世界模型的拥趸

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier