ChatGPT联网功能正式上线,

原创 机器之心

编辑:张倩、陈萍

GPT-4 和强化学习强强联合,机器人的未来将是什么样子?

在学习方面,GPT-4 是一个厉害的学生。在消化了大量人类数据后,它掌握了各门知识,甚至在聊天中能给数学家陶哲轩带来启发。

与此同时,它也成为了一名优秀的老师,而且不光是教书本知识,还能教机器人转笔。

这个机器人名叫 Eureka,是来自英伟达、宾夕法尼亚大学、加州理工学院和得克萨斯大学奥斯汀分校的一项研究。这项研究结合了大型语言模型和强化学习的研究成果:用 GPT-4 来完善奖励函数,用强化学习来训练机器人控制器。

借助 GPT-4 写代码的能力,Eureka 拥有了出色的奖励函数设计能力,它自主生成的奖励在 83% 的任务中优于人类专家的奖励。这种能力可以让机器人完成很多之前不容易完成的任务,比如转笔、打开抽屉和柜子、抛球接球和盘球、操作剪刀等。不过,这一切暂时都是在虚拟环境中完成的。

此外,Eureka 还实现了一种新型的 in-context RLHF,它能够将人类操作员的自然语言反馈纳入其中,以引导和对齐奖励函数。它可以为机器人工程师提供强大的辅助功能,帮助工程师设计复杂的运动行为。英伟达高级 AI 科学家 Jim Fan 也是该论文的作者之一,他将这项研究比喻为「物理模拟器 API 空间中的旅行者号(美国研制并建造的外层星系空间探测器)」。

值得一提的是,这项研究是完全开源的,开源地址如下:

论文链接:https://arxiv.org/pdf/2310.12931.pdf

项目链接:https://eureka-research.github.io/

代码链接:https://github.com/eureka-research/Eureka

论文概览

大型语言模型(LLM)在机器人任务的高级语义规划方面表现出色(比如谷歌的 SayCan、RT-2 机器人),但它们是否可以用于学习复杂的低级操作任务,如转笔,仍然是一个悬而未决的问题。现有的尝试需要大量的领域专业知识来构建任务提示或只学习简单的技能,远远达不到人类水平的灵活性。

谷歌的 RT-2 机器人

另一方面,强化学习(RL)在灵活性以及其他许多方面取得了令人印象深刻的成果(比如 OpenAI 会玩魔方的机械手),但需要人类设计师仔细构建奖励函数,准确地编纂并提供所需行为的学习信号。由于许多现实世界的强化学习任务只提供难以用于学习的稀疏奖励,因此在实践中需要奖励塑造(reward shaping),以提供渐进的学习信号。尽管奖励函数非常重要,但众所周知,它很难设计。最近的一项调查发现,92% 的强化学习受访研究人员和从业者表示,他们在设计奖励时进行了人工试错,89% 的人表示他们设计的奖励是次优的,会导致非预期行为。

鉴于奖励设计如此重要,我们不禁要问,是否有可能利用最先进的编码 LLM(如 GPT-4)来开发一种通用的奖励编程算法?这些 LLM 在代码编写、零样本生成以及 in-context learning 等方面表现出色,曾经大大提升了编程智能体的性能。理想情况下,这种奖励设计算法应具有人类水平的奖励生成能力,可扩展到广泛的任务范围,在没有人类监督的情况下自动完成乏味的试错过程,同时与人类监督兼容,以确保安全性和一致性。

这篇论文提出了一种由 LLM 驱动的奖励设计算法 EUREKA(全称是 Evolution-driven Universal REward Kit for Agent)。该算法达成了以下成就:

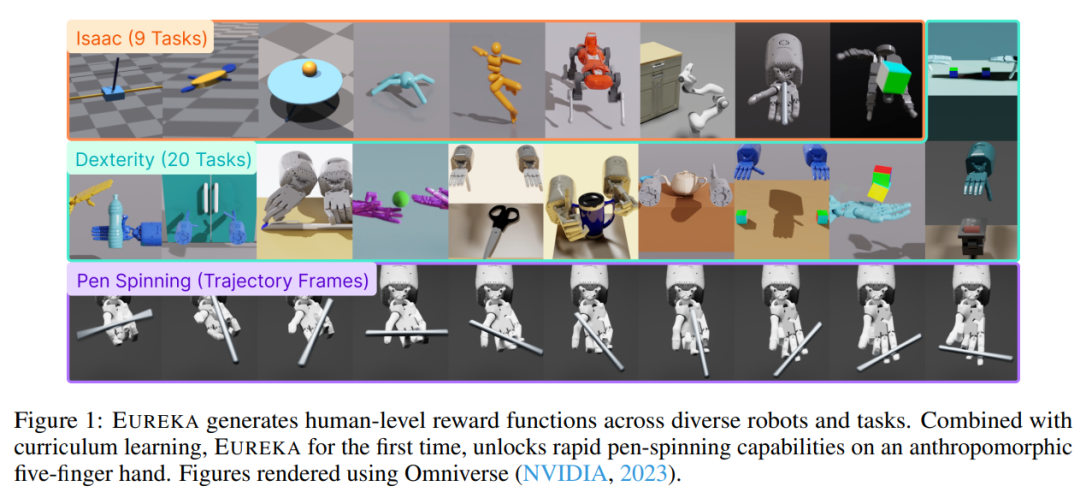

1、在 29 种不同的开源 RL 环境中,奖励设计的性能达到了人类水平,这些环境包括 10 种不同的机器人形态(四足机器人、四旋翼机器人、双足机器人、机械手以及几种灵巧手,见图 1。在没有任何特定任务提示或奖励模板的情况下,EUREKA 自主生成的奖励在 83% 的任务中优于人类专家的奖励,并实现了 52% 的平均归一化改进。

2、解决了以前无法通过人工奖励工程实现的灵巧操作任务。以转笔问题为例,在这种情况下,一只有五根手指的手需要按照预先设定的旋转配置快速旋转钢笔,并尽可能多地旋转几个周期。通过将 EUREKA 与课程学习相结合,研究者首次在模拟拟人「Shadow Hand」上演示了快速转笔的操作(见图 1 底部)。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier