BTC大涨带动BRC-20板块,哪

原文来源:量子位

图片来源:由无界 AI生成

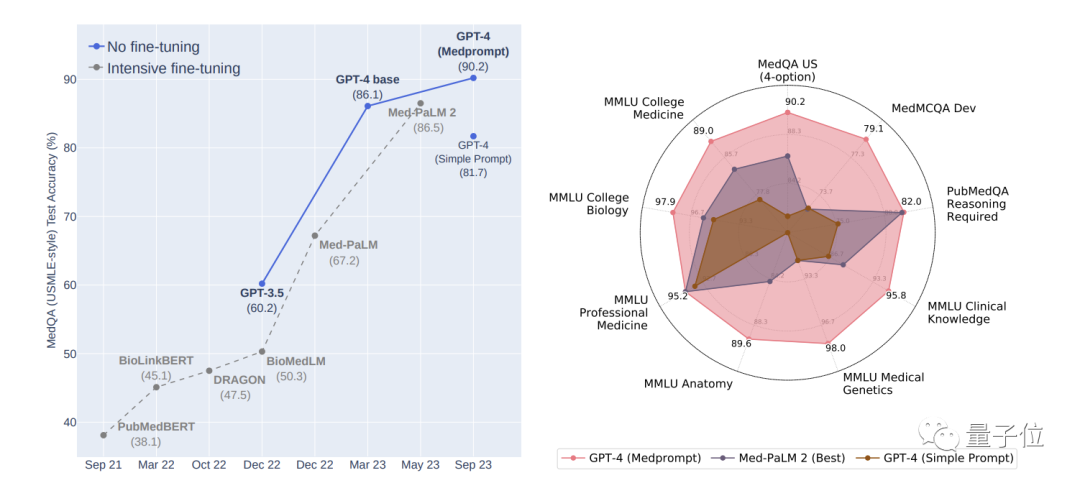

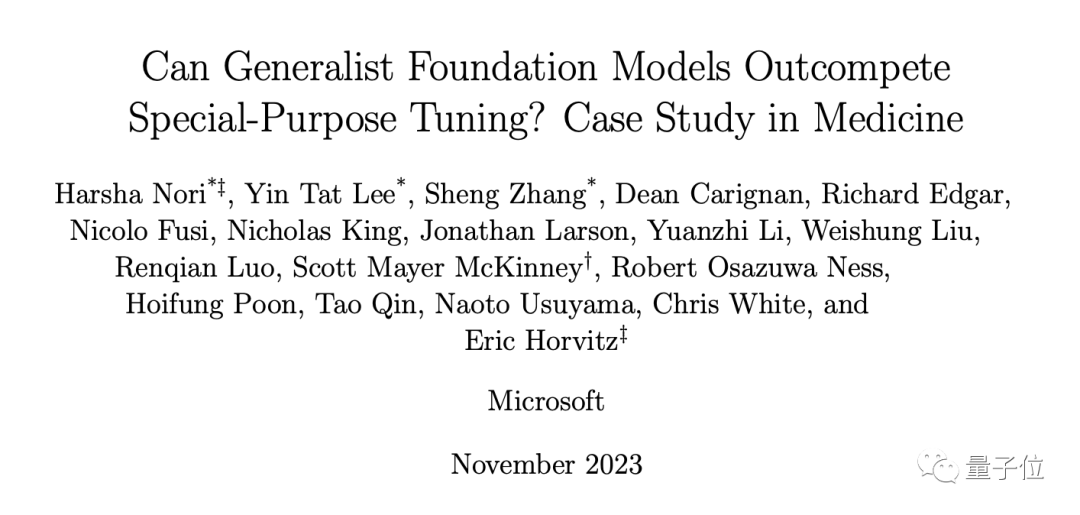

微软最新研究再次证明了提示工程的威力——无需额外微调,无需专家策划,仅凭提示,GPT-4就能化身“专家”。

使用他们提出的最新提示策略Medprompt,在医疗专业领域,GPT-4在MultiMed QA九个测试集中取得最优结果。

在MedQA数据集(美国医师执照考试题)上,Medprompt让GPT-4的准确率首次超过90%,超越BioGPT和Med-PaLM等一众微调方法。

研究人员还表示Medprompt方法是通用的,不仅适用于医学,还可以推广到电气工程、机器学习、法律等专业中。

这项研究在X(原Twitter)一经分享,就引发众多网友关注。

沃顿商学院教授Ethan Mollick、Artificial Intuition作者Carlos E. Perez等都有转发分享。

Carlos E. Perez直呼“出色的提示策略可以甩微调一大截”:

有网友表示早就有这种预感,现在能看到结果出来,真的是“so cool”:

还有网友表示这真的很“激进”:

GPT-4是一项能改变行业的技术,而我们还远没有触及提示的极限,也未达到微调极限。

组合提示策略,“变身”专家

Medprompt是多种提示策略的组合体,包含三大法宝:

动态少样本选择(Dynamic few-shot selection) 自生成思维链(Self-generated chain of thought) 选项洗牌集成(Choice shuffling ensemble)

下面我们来一一介绍。

动态少样本选择

少样本学习是让模型快速学习上下文的一种有效的方法。简单来说,就是输入一些示例,让模型快速适应特定领域,并学习遵循任务的格式。

这种用于特定任务提示的少样本示例通常是固定的,所以对示例的代表性和广泛性有较高的要求。

之前一种方法是让领域专家手动制作范例,但即便如此,也不能保证专家策划的固定的少样本示例在每个任务中都有代表性。

因此,微软研究人员提出了动态少样本示例的方法。

想法是,任务训练集可以作为少样本示例的来源,如果训练集足够大,那就可以为不同的任务输入选择不同的少样本示例。

具体来说,研究人员先利用text-embedding-ada-002模型为每个训练样本和测试样本生成向量表示。然后,对于每个测试样本,基于向量相似度,从训练样本中挑选出最相似的k个样本。

与微调方法相比,动态少样本选择利用了训练数据,但不需要对模型参数进行大量更新。

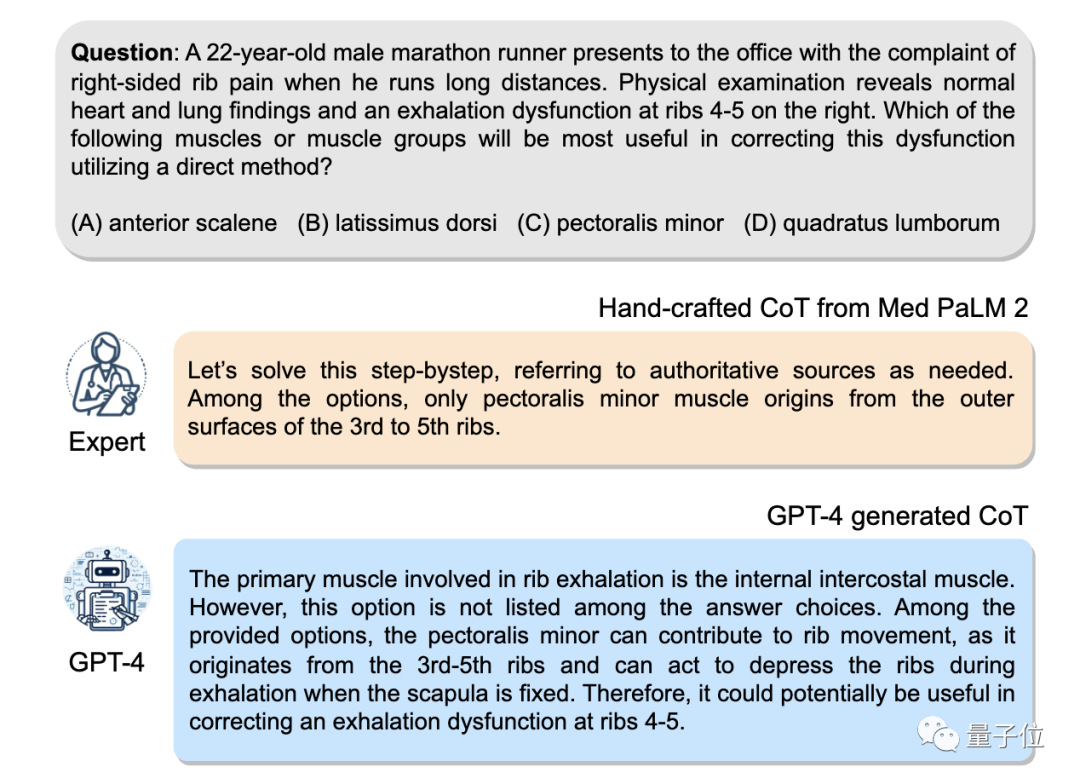

自生成思维链

思维链(CoT)方法就是让模型一步一步思考,生成一系列中间推理步骤。

之前一种方法也是依赖专家手动编写少量的带有提示思维链的示例。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier