为什么说比特币生态必将

文章来源:量子位

图片来源:由无界 AI生成

进入多模态时代,大模型也会操纵无人机了!

只要视觉模块捕捉到启动条件,大模型这个“大脑”就会生成动作指令,接着无人机便能迅速准确地执行。

北京航空航天大学智能无人机团队周尧明教授团队等研究人员,提出了一种基于多模态大模型的具身智能体架构。

目前,这种架构已被应用于无人机的操控。

那么这种新的智能体表现如何,又有哪些技术细节呢?

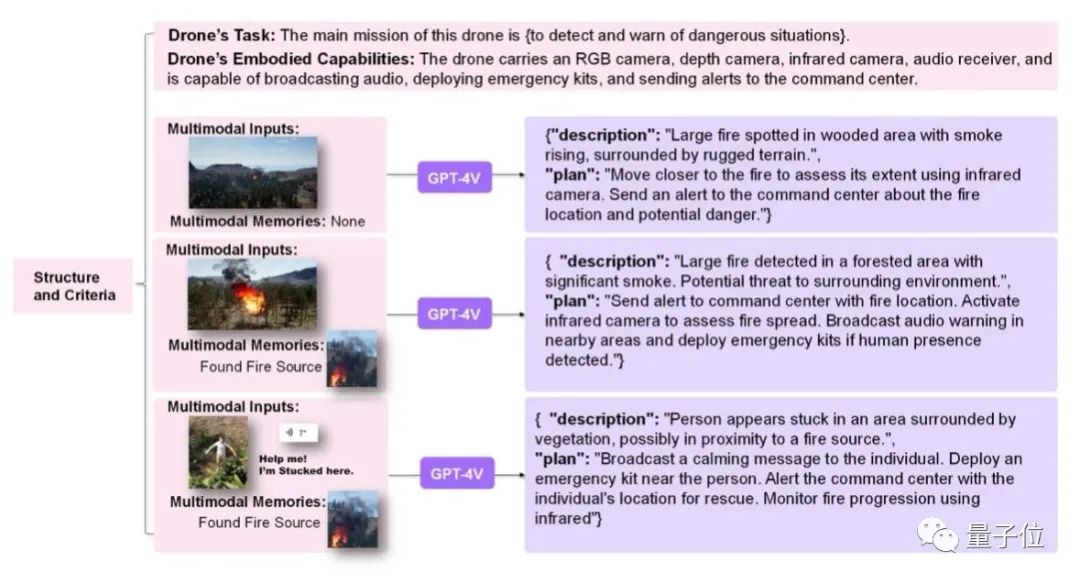

研究团队利用大模型对多模态数据的理解能力,将真实物理世界的照片、声音、传感器数据等多源信息融合成能体的感知,将对于真实世界的执行器的操作作为智能体的行为。

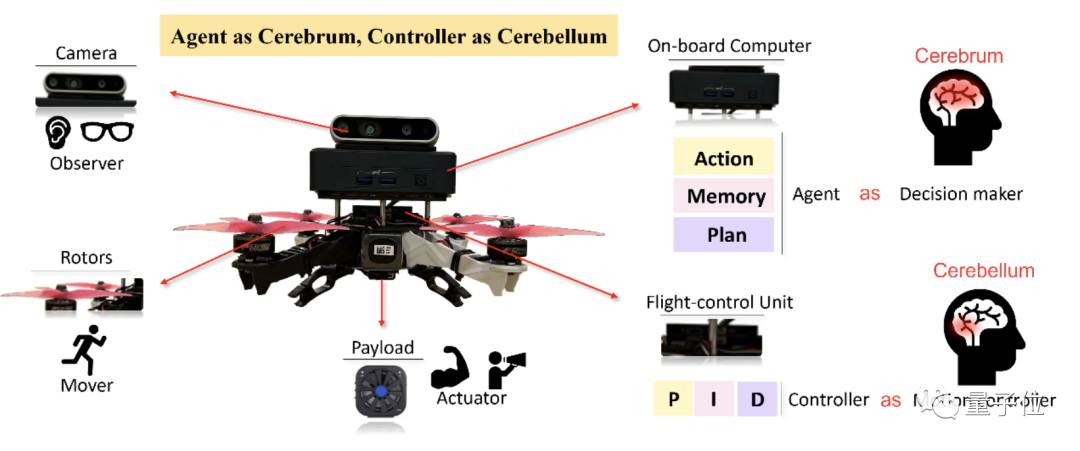

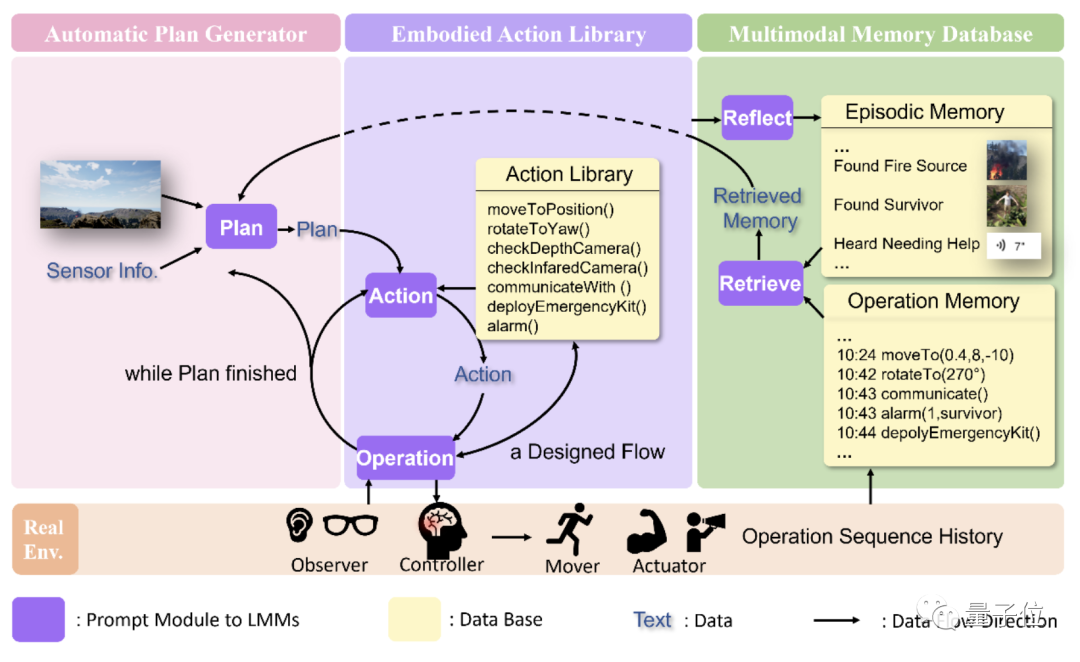

同时,团队提出了一套“Agent as Cerebrum,Controller as Cerebellum”(智能体即大脑,控制器即小脑)的控制架构:

智能体作为大脑这一决策生成器,专注于生成高层级的行为;

控制器作为小脑这一运动控制器,专注于将高层级的行为(如期望目标点)转换成低层级的系统命令(如旋翼转速)。

具体来说,研究团队认为这一成果主要有三项贡献。

研究团队提出了一种应用于实际机器人的新的系统架构,将基于多模态大模型的智能体具象化为大脑。

而机器人运动规划器与控制器则被具象化为小脑,机器人的感知系统类比为人的眼、耳等信息收集器,机器人的执行机构类比为人的手等执行器。

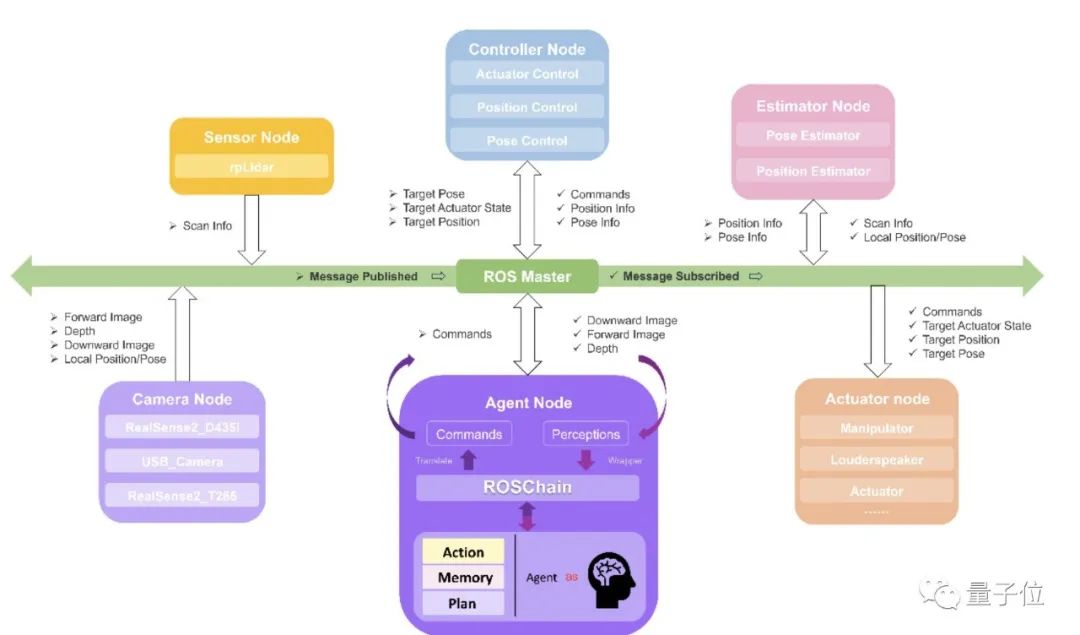

这些节点通过ROS相连,通过ROS中消息的订阅与发布或服务的请求与响应实现通信,区别于传统的端到端的机器人大模型控制。

这一架构使得Agent可以专注于高层级命令的产生,对于高层级任务具备更强的智能性,对于实际的执行具备更好的鲁棒性和可靠性。

在这一架构下,作者构建了作为大脑的一种智能体AeroAgent。

该智能体主要包括三个部分:

同时,一个动作的完成,可能需要多次操作的交互以从传感器获取动作的执行所必需的参数,确保智能体可以根据综合态势感知及所具备的执行器来进行稳定的embodied action的输出。

为了给具身智能体和ROS机器人系统建立桥梁,让Agent产生的操作能够正确地、稳定地发送给ROS并被其他节点成功执行,同时让其他节点所提供的信息让LMM能够读取与理解,团队设计了了ROSchain——

一个连接LLMs/LMMs与ROS的桥梁。

ROSchain通过一套模块和应用程序接口(APIs)简化了大型模型与机器人传感装置、执行单元和控制机制的集成,为智能体接入ROS系统提供了一个稳定的中间件。

至于为什么选择无人机进行该系统架构的测试与模拟,研究团队也做了解释,这主要有三个原因。

首先,如今LMMs中所蕴含的web-scale的世界知识,多为第三人称视角,人型机器人等领域的具身智能是类似于以人类为主体出发的第一人称视角。

而无人机挂载的相机(尤其是下视相机)更加类似于第三人称视角(上帝视角)的具身智能;

另一方面,现阶段的LMMs无论是模型部署还是API服务,通常受限于计算资源导致响应有一定的延迟。

这对于自动驾驶等领域是一个应用的障碍,而无人机的任务规划由于其可以悬停,具备应对延迟的能力。

这两点都导致目前技术发展水平下无人机适合作为先驱进行相关理论与应用的验证。

第二,目前工业无人机领域,如山火救援、农林植保、无人放牧、电力巡检等,多由飞手与专家配合实际操作,智能化任务执行具有工业需求。

第三,从未来发展看,多智能体协同合作在物流、建筑、工厂等领域具备较为明显的需求。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier