Fabric Ventures:Web3和没有

来源:机器之心

图片来源:由无界 AI生成

文生视频领域又卷起来了!

文生视频可以精细到什么程度?最近,阿里巴巴的一项研究给出了答案:1280×720 分辨率没有压力,而且生成效果非常连贯。

文本提示:A kitten in flowers, Chinese painting.(一只小猫在花丛中,中国画。)

文本提示:A yellow robot.(一个黄色的机器人)

文本提示:A photo of an ancient shipwreck nestled on the ocean floor. Marine plants have claimed the wooden structure...(海底一艘古老沉船的照片。海洋植物侵蚀了木结构……)

这些 demo 来自阿里联合浙江大学、华中科技大学提出的文生视频模型 I2VGen-XL,该模型能够生成各种类别的高质量视频,如艺术画、人像、动物、科幻图等。生成的视频具有高清、高分辨率、平滑、美观等优点,适合广泛的视频内容创作任务。在与 Gen2、Pika 生成效果对比上, I2VGen-XL 生成的视频动作更加丰富,主要表现在更真实、更多样的动作,而 Gen-2 和 Pika 生成的视频似乎更接近静态。

除了生成效果,这项工作更令人印象深刻的一点是研究人员在数据上下的工夫。为了提高生成效果的多样性,研究人员收集了大约 3500 万单镜头文本 - 视频对和 60 亿文本 - 图像对来优化模型,这是一个非常庞大的数据集,其后续潜力令人期待。

论文细节

论文地址:https://arxiv.org/pdf/2311.04145.pdf

论文主页:https://i2vgen-xl.github.io/page04.html

论文地址:https://arxiv.org/pdf/2311.04145.pdf

论文主页:https://i2vgen-xl.github.io/page04.html

该研究表示得益于扩散模型的快速发展,视频合成最近取得了显著的进步。然而,它在语义的准确性、清晰度和时空连续性方面仍然面临挑战。

出现这种状况的原因一方面是由于缺乏良好的经过对齐的文本 - 视频数据,另一方面在于视频本身复杂的内在结构,使得模型难以同时保证语义和质量的卓越性。

为了解决上述问题,研究者受到 SDXL 方法的启发,提出了一种级联的 I2VGen-XL 方法,其能够生成具有连贯空间和运动动态化以及细节连续的高清视频。

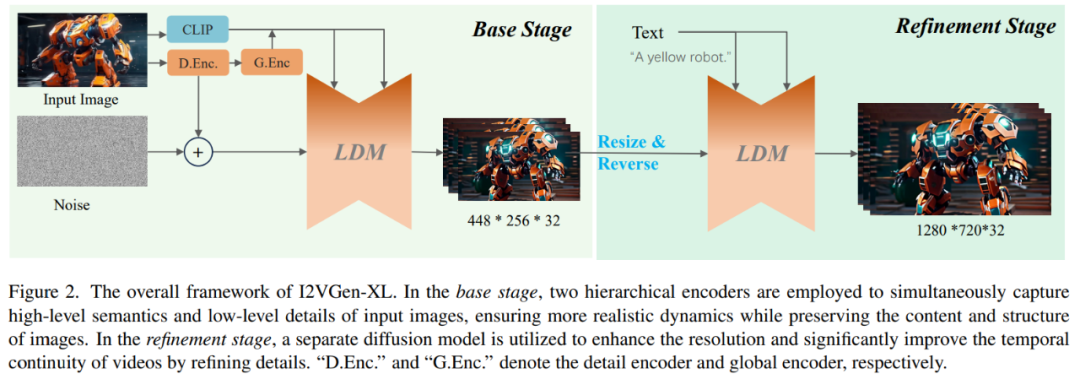

I2VGen-XL 旨在从静态图像生成高质量视频。因此,它需要实现两个关键目标:语义一致性,即准确预测图像中的意图,然后在保持输入图像的内容和结构的同时生成精确的运动;高时空一致性和清晰度,这是视频的基本属性,对于确保视频创作应用的潜力至关重要。为此,I2VGenXL 通过由两个阶段组成的级联策略分解这两个目标:基础阶段和改进阶段。

基础阶段旨在保证低分辨率下生成视频的语义连贯,同时还要保留输入图像的内容和主体信息。为了达到这一目标,研究者设计了两个分层编码器,即固定 CLIP 编码器和可学习内容编码器,分别提取高级语义和低级细节,然后将其合并到视频扩散模型中。 改进阶段:将视频分辨率提高到 1280×720,并改进生成视频中存在的细节和伪影。具体来说,研究者使用简单的文本作为输入来训练一个独特的视频扩散模型,并优化了其初始的 600 个去噪 step。通过使用噪声去噪过程,该研究实现了从低分辨率视频生成具有时间和空间一致性的高清视频。

具体而言:

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier