美元/日元小幅上涨,日本

原文来源:光锥智能

文|郝 鑫

编|刘雨琦

图片来源:由无界 AI生成

“99%的行业大模型都可能被替代”,百川智能联合创始人、联席总裁洪涛一语落地,震惊四座。

百模大战中,行业大模型一直都是焦点所在,原因归结起来有两点,一是和研发厂商的技术、业务结合快,二是需求明确,实际落地速度与商业化远超于通用大模型。

但这样的行业大模型通常得靠微调、精调的方式来完成,弊端也十分显而易见,训练时间长、部署成本高,还涉及企业数据隐私问题。

基于此,国内外都在找寻最优解,并形成了两种探索路径:

一种以Pinecone、Zilliz为代表的数据库公司,带火的向量数据库路线;一种是OpenAI引领起的RAG(检索增强生成)路线。

若以形象的比喻来解释,精调、向量数据库和RAG三者的区别,大模型微调好比供一个孩子从小学念到大学甚至研究生;向量数据库和RAG则更像开卷考试,不需要学习理解就能给出答案。

简而言之,向量数据库和RAG都是在不更改模型的基础上,通过一些“外挂”的手段来提升大模型应用的准确性,以此来弥补大模型自身存在的幻觉、时效性差、缺乏专业领域知识等缺陷。

尽管是两条路径选择,但向量数据库和RAG也不是完全对立,向量数据库中需要检索,RAG过程中也存在向量化阶段,只不过侧重点有所不同。

在国内,腾讯更加侧重向量数据库方向,并将其升至战略地位,做出了“大模型是计算引擎,改变的是计算方式,存储需要向量数据库”的判断。

12月,百川智能开放基于搜索增强的Baichuan2-Turbo系列API,结合RAG和向量数据库两条路线,打出了一套“大模型+超长上下文窗口+搜索增强知识库”的组合拳。

百川智能创始人、CEO王小川也给出了自己的论断:“大模型+搜索增强是大模型时代的新计算机,大模型类似于计算机的CPU,互联网实时信息与企业完整知识库共同构成了大模型时代的硬盘”。

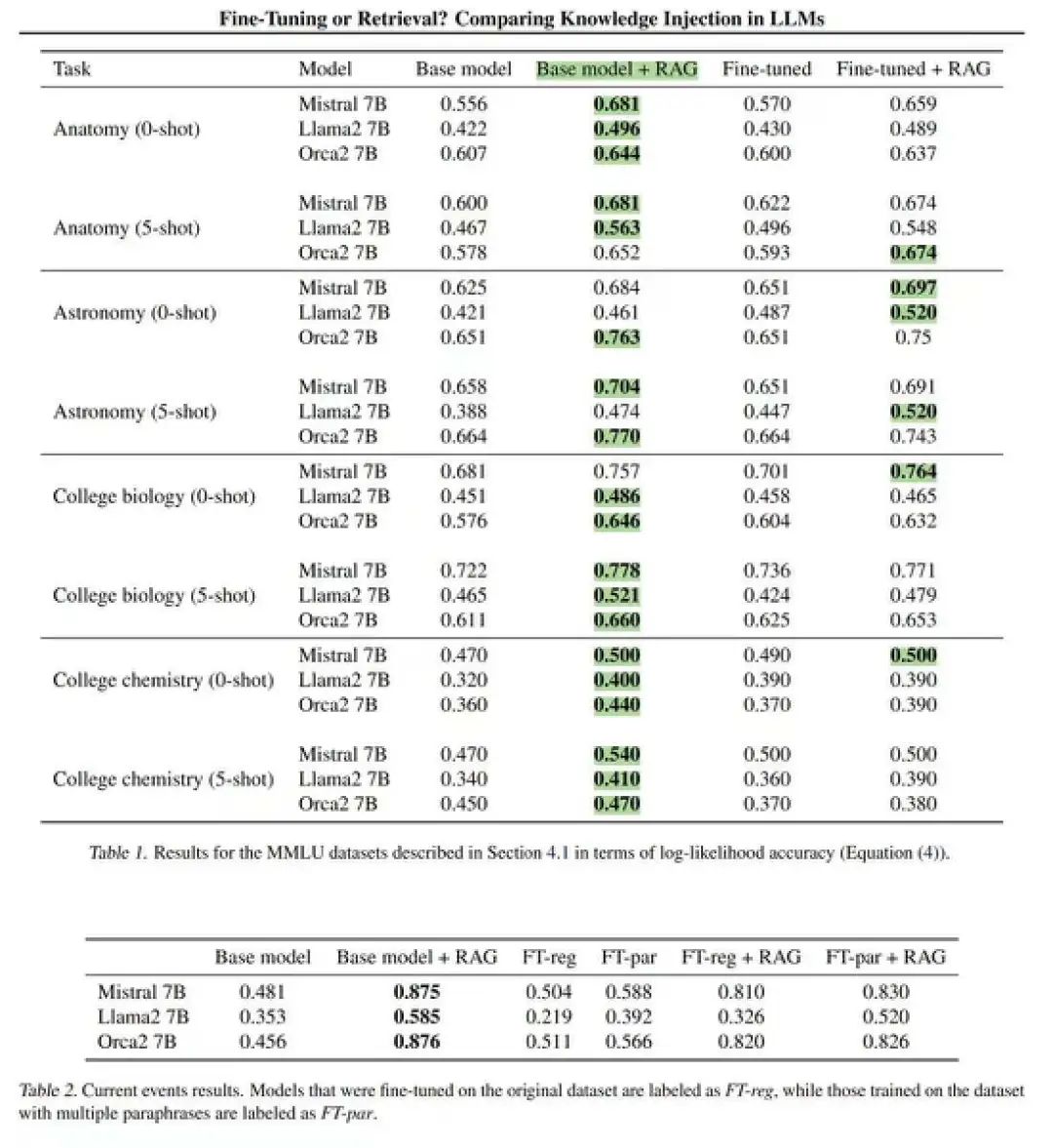

(图:实验证明RAG+大模型的效果要好于精调大模型,来自微软论文)

“从方方面面来看,搜索增强要比精调行业大模型更具性价比”,王小川道。

光锥智能在沟通会现场对话王小川,深入了解,作为较早选择RAG和向量数据库路线的企业,如何在技术上进行思考和突破?又如何在行业应用中落地?

核心观点如下:

1、搜索增强是大模型走向实用的第一步,甚至是最关键的一步。

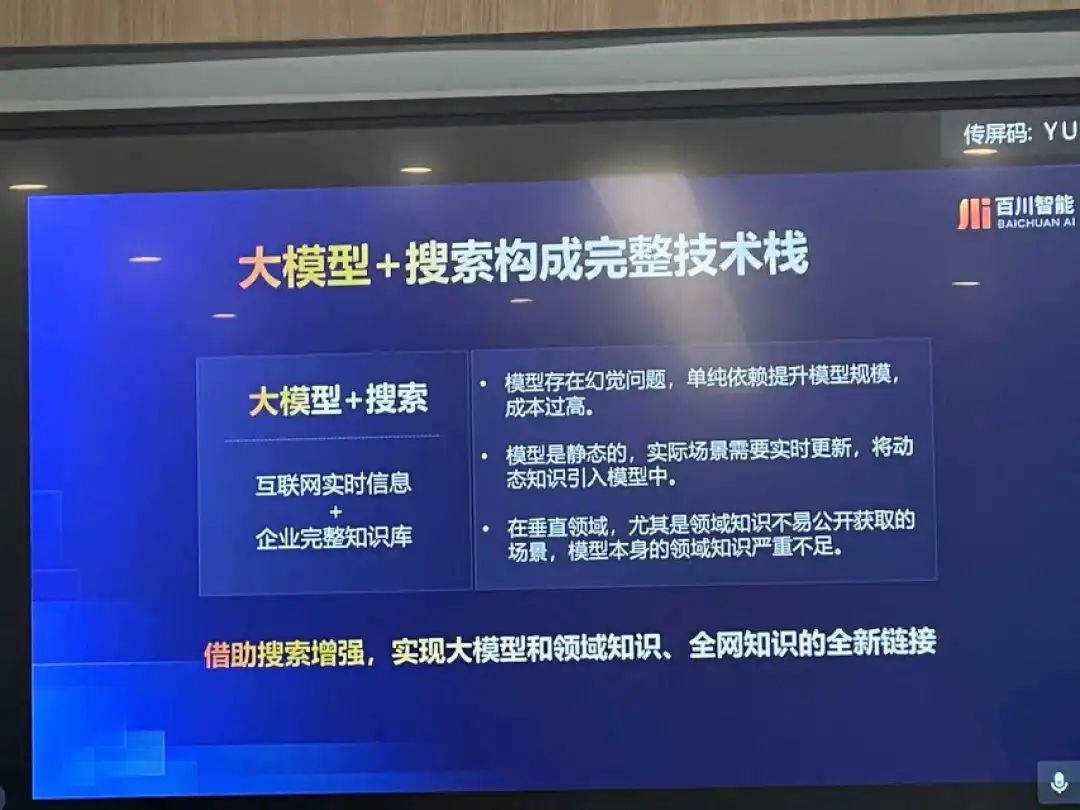

2、大模型+搜索构成完整技术栈,实现了大模型和领域知识、全网知识的全新链接。

3、大模型+搜索增强是大模型时代的新计算机,大模型类似于CPU,互联网实时信息与企业完整知识库是硬盘。

4、避免项目化,用产品化取代项目化,用定制化的能力,实现企业的低成本定制。

5、中国大模型技术进化比想象中要快得多,追赶方向主要集中在文本领域。

以下为对话实录:

Q:在RAG提出之前,行业有哪些解决大模型缺陷的手段?

王小川:业界探索了多种解决方案,包括扩大参数规模、扩展上下文窗口长度、为大模型接入外部数据库,使用特定数据训练或微调垂直行业大模型等。这些路线各有优势,但也都存在自身的局限。

例如,持续扩大模型参数虽然能够不断提升模型智能,但是需要海量数据和算力的支撑,巨额的成本对中小企业非常不友好,而且完全依靠预训练也很难解决模型的幻觉、时效性等问题。所以,业界亟需找到一条集诸多优势于一体的路径,将大模型的智能切实转化为产业价值。

Q:百川智能提出的“搜索增强”概念与大火的RAG技术思路十分契合,如何理解“大模型+搜索”?

王小川:大模型+搜索增强是大模型时代的新计算机,大模型类似于计算机的CPU,通过预训练将知识内化在模型内部,然后根据用户的Prompt生成结果;上下文窗口可以看做计算机的内存,存储了当下正在处理的文本;互联网实时信息与企业完整知识库共同构成了大模型时代的硬盘。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier