美元/日元小幅上涨,日本

近日,苹果连发两篇论文,不仅能一键生成逼真的3D化身,而且还要把大模型装进你的iPhone

原文来源:新智元

图片来源:由无界 AI生成

想不想在你的iPhone上本地运行GPT-4?

也许在不久的将来,这个幻想就会照进现实!

近日,苹果发布了一篇深受业界瞩目的文章,目的是探索在有限的内存中运行大语言模型。

论文地址:https://arxiv.org/pdf/2312.11514.pdf

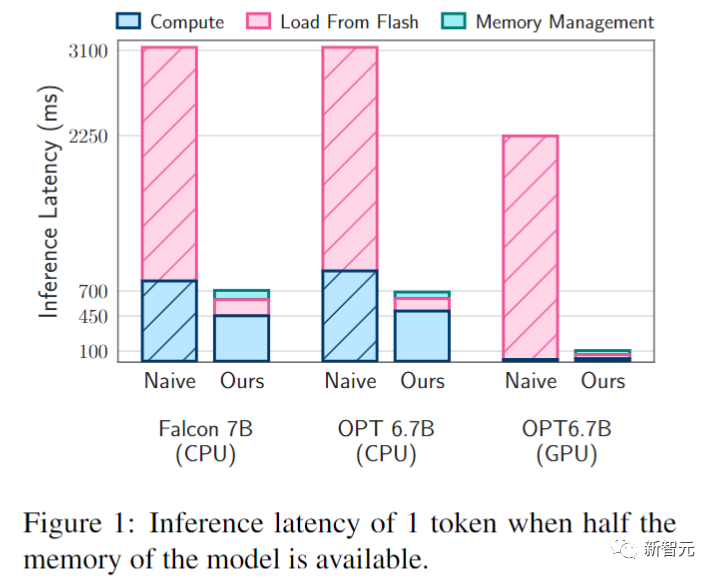

苹果通过软硬件协同优化,使设备能够支持运行的模型大小达到了自身DRAM的两倍!

在这项技术的加持之下,LLM的推理速度在Apple M1 Max CPU上提高了4-5倍,在GPU上提高了20-25倍。

在上图给出的LLM推理延迟的比较中,我们可以看到苹果提出的方法效果相当出色。

而这些优化可能很快就可以让复杂的AI助手,或者是聊天机器人在iPhone、iPad和其他移动设备上流畅运行。

面对当下由生成式AI引领的革命,

多数人希望把模型做大做强,比如可能有万亿参数的GPT-4(OpenAI家的登月计划更是夸张);

另一部分人则在探索「小模型」的潜力,比如以7B参数打平70B Llama的Zephyr,以及2.7B参数却表现强劲的Phi-2;

事实上,在AI算力的发展道路上,摩尔定律似乎缓缓下车了,于是「内存墙」的问题渐渐暴露出来。

对此,苹果这次选择了另外一条道路,利用自身「闭源」的优势,充分发挥软件和硬件的特性,誓要把大模型装进你的iPhone!

在这篇工作中,研究人员通过将模型参数存储在闪存中,并按需将其引入 DRAM,成功高效运行了超出自身DRAM容量的LLM。

——这对于消费者来说也是个好消息,毕竟我们都知道,苹果的内存是金子做的,这下妈妈再也不用担心大模型时代要掏更多的钱买iPhone了。

除了这个神级的优化方案,苹果科学家还在之前的一篇研究论文中,提出了HUGS(人类高斯飞溅)。

论文地址:https://arxiv.org/pdf/2311.17910.pdf

HUGS可以从单个相机拍摄的视频中生成动画3D头像,

只需要拍摄少量(50-100)帧的单目视频,HUGS就会自动学习,分离出静态场景,并生成完全可动画的人类化身。

,时长00:52

HUGS使用3D高斯溅射来表示人类和背景场景。人体模型是从称为SMPL的统计体型模型初始化的。

但HUGS允许高斯偏离,从而能够捕捉到衣服和头发等细节。

新颖的神经变形模块(neural deformation module)使用线性混合蒙皮,以逼真的方式对高斯进行动画处理。

这种协调的运动避免了在放置化身时出现的伪影,能够实现人类的新姿势合成和场景的新视角合成。

与以前的头像生成方法相比,HUGS在训练和渲染方面的速度提高了100倍。——在典型的游戏GPU上仅需30分钟就可以生成逼真的结果。

,时长00:18

也许在不久的将来,这种实时性能,以及从视频创建化身的能力,可以为虚拟试妆、远程呈现和合成媒体带来新的可能性。

——想象一下,未来你可以用iPhone相机做同样的事情,是不是很期待?

通过上面介绍的这两项工作,iPhone和iPad用户可以在设备本地运行复杂的AI系统,并感受到更加身临其境的视觉体验。

有限内存跑大模型的方法

苹果的研究人员构建了一个与闪存行为相协调的推理成本模型,并瞄准两个关键领域进行优化:

减少从闪存传输的数据量,以及在更大、更连续的块中读取数据。

在这个闪存信息框架中,主要有两种优化技术。

首先是「窗口化」,通过重用先前激活的神经元来战略性地减少数据传输,

其次是「行列捆绑」,根据闪存的顺序数据访问强度量身定制,增加了从闪存读取的数据块的大小。

研究人员在整个优化过程中,集成了稀疏感知、上下文自适应加载和面向硬件的设计。

当可用计算内存远小于模型大小时,需要将完整的模型权重存储在闪存中。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier