美元/日元小幅上涨,日本

从此以后,Google Scholar 数据该出问题了。

原文来源:机器之心

图片来源:由无界 AI生成

备受期待的谷歌 Gemini 技术报告完整版,今天终于出炉了。

两周前,人们兴奋于谷歌提出的「原生多模态大模型」Gemini,其宣称超越 GPT-4 的强大性能,以及对于图像、视频等领域的理解能力让人们似乎看到了未来。不过由于谷歌演示的 demo 涉嫌夸大效果,Gemini 又很快陷入了争议。

但作为生成式 AI 领域最近的重要进展,人们对于 Gemini 的期待越来越高,有团队很快进行研究发了测试论文。今天发布的 64 页技术报告,或许可以为我们的许多疑惑进行更加直观的解释。

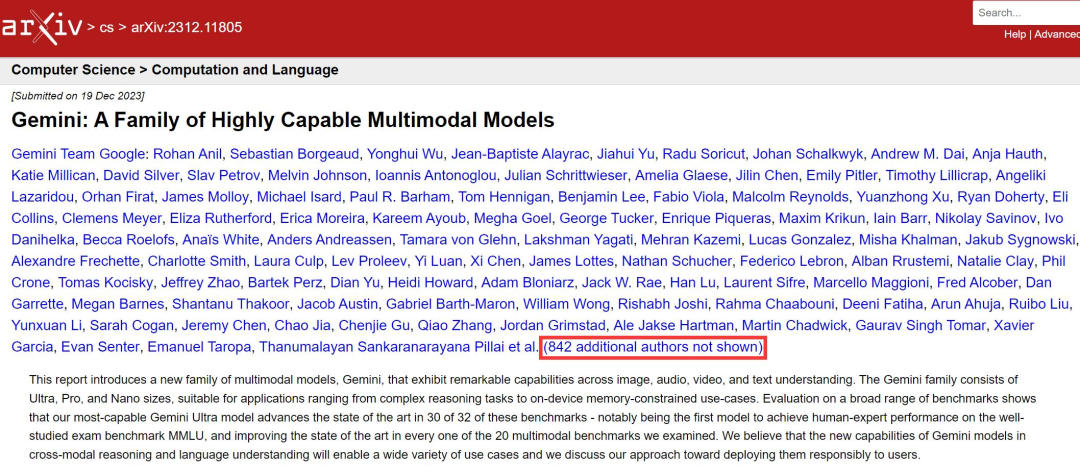

这篇技术报告《Gemini: A Family of Highly Capable Multimodal Models》作者包括 Jeff Dean、Oriol Vinyals、Koray Kavukcuoglu、Demis Hassabis 等一众谷歌研究大佬,另外还有谢尔盖・布林这样的公司联合创始人。

论文链接:https://arxiv.org/abs/2312.11805

另外,该文章的作者数量也夺人眼球 ——941 个人,搞得 arXiv 网页都有点卡:

一页显示不过来。

从文章第 35 页起,谷歌开始罗列所有「贡献者」,从 Team Leader 到主要贡献者,再到贡献者分门别类写到了第 45 页,看起来之前各路媒体说谷歌在 Gemini 上投入了大量工程师,的确是没说错。

谷歌表示,在每个任务方向上,人们对 Gemini 所做的贡献是同等重要的,名字按随机顺序列出。Gemini 是一项跨谷歌内部多团队的工作,成员来自 Google DeepMind、Google Research、Knowledge and Information、Core ML、Cloud、Labs 等部门。

此外还有提供了支持的团队和人(比如公司 CEO 桑达尔・皮查伊),以及没有列出的很多谷歌内部贡献者。

对此有人吐槽道,论文作者比解释技术写的还长,你这怕不是在水字数?

光是这些花费在这些工程师、科学家们身上的工资每年就有上亿美元。

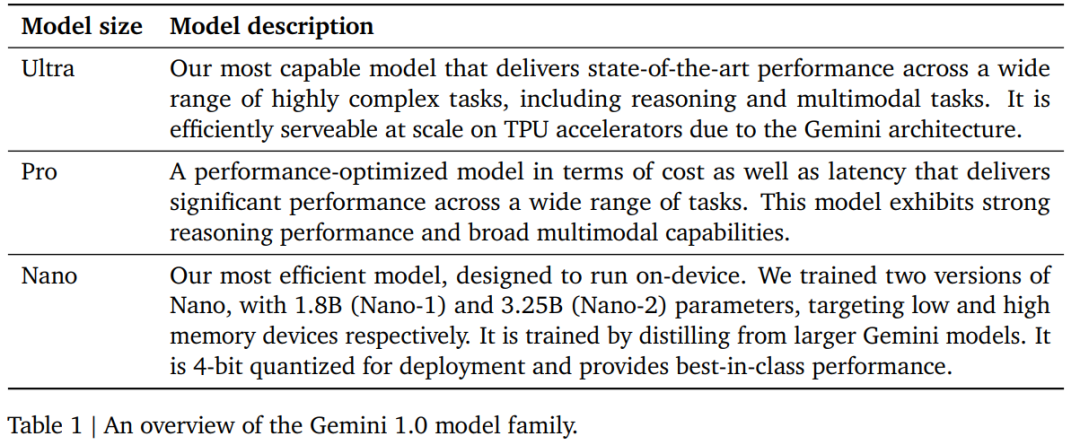

在技术报告中,谷歌表示 Gemini 是一个多模态大模型体系,它在图像、音频、视频和文本理解方面表现出卓越的能力。Gemini 系列包括 Ultra、Pro 和 Nano 三个版本,适用于从复杂推理任务到移动设备的各种应用。

通过在大量基准的跑分表明,功能最强大的 Gemini Ultra 在 32 个基准中的 30 个中刷新了 SOTA(业内最佳)水平。谷歌特别指出,Gemini 是第一个在经过充分研究的考试基准 MMLU 上实现人类专家表现的模型。谷歌相信,Gemini 在跨模态推理和语言理解方面的突出能力将支持各种用例。

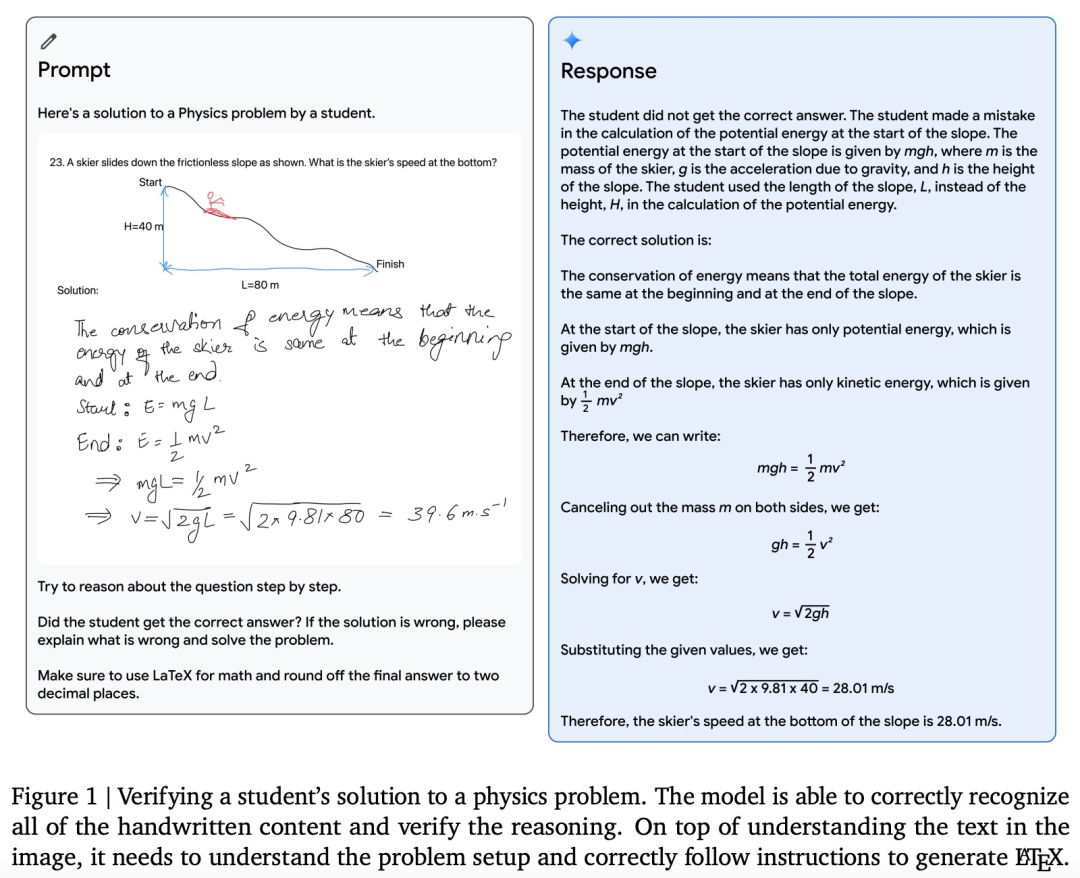

以下图所示的教育环境为例,老师画了一个滑雪者从斜坡上滑下的物理问题,学生试图进行解答。利用 Gemini 的多模态推理能力,该模型能够理解凌乱的笔迹,正确理解问题的表述,将问题和解决方案都转换为数学排版,识别学生在解决问题时出错的具体推理步骤,然后给出问题的正确解法。

图 1,笔记识别,解答物理问题。

Gemini 的推理能力展示了构建能解决更复杂多步骤问题的通用智能体的前景,比如谷歌基于 Gemini 提出了 AlphaCode 2。在移动设备上,Gemini Nano 在摘要、阅读理解、文本填充任务等任务中表现出色,也体现了推理、STEM、编码、多模态和多语言任务的能力。

在文章的技术解释部分中,谷歌概述了 Gemini 的模型架构、训练基础设施和训练数据集,对 Gemini 模型系列进行了详细评估,涵盖文本、代码、图像、音频和视频方面。谷歌讨论了模型审核与部署方法,最后也讨论了 Gemini 的更广泛影响、局限性及其潜在应用。

模型架构

Gemini 1.0 有三种尺寸 Ultra 、 Pro 以及 Nano ,如下所示:

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier