Bankless:ETF、减半、降息,

原文来源:硅星人

图片来源:由无界 AI生成

利用人工智能来合成视频一直是该领域的难题,因为其中最关键的一环——映射与合成,缺乏优秀的模型算法,只能利用卷积神经网络(CNN)和生成对抗网络(GAN)来不断提取特征、生成、判断,直至最后结果。比如此前曾大火的Deepfake技术,俗称人工智能换脸,生成一个短短几秒的“换头”视频也需要10分钟左右的时间。

以后就不一样了,Meta在12月的月末发布了一篇论文《Fairy: Fast Parallelized Instruction-Guided Video-to-Video Synthesis》。论文提出了一个新的模型,也就是标题中的Fairy。Fairy能够在仅14秒内生成120帧的512x384分辨率视频(30 FPS,时长为4秒),超过了之前的方法至少44倍的速度。

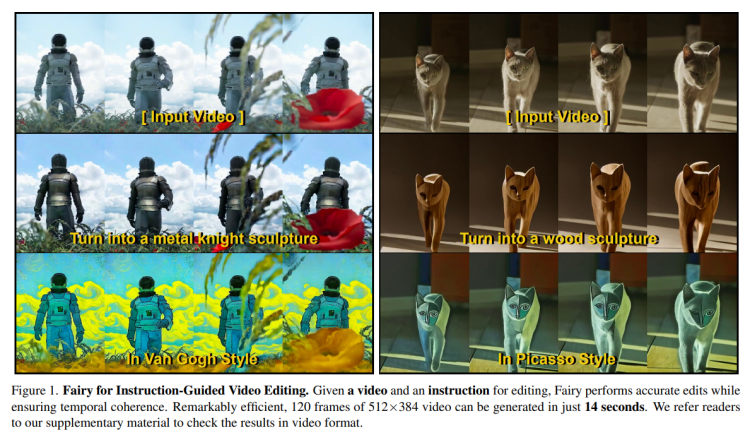

原图Fairy合成的视频

这是一种比较另类的图像编辑扩散模型,使其摇身一变,成为了视频编辑应用。

Fairy的技术核心是“锚点式跨帧注意力”机制,它可以在帧之间隐式传播扩散特征,确保时间上的连贯性和高保真度合成。有了这个机制后,Fairy不仅解决了以前模型中的内存和处理速度限制,还通过独特的数据增强策略改进了时间一致性。这种策略使模型对源图像和目标图像中的仿射变换保持等变性。

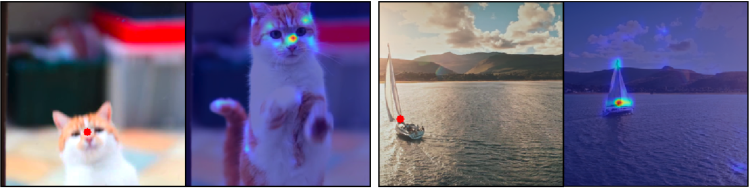

“锚点式跨帧注意力”说的直白一点,就是允许模型在不同帧之间建立时间对应关系。比如下面这几张图,左边的猫和右边的船上面都有一个红点,代表模型定位了图中物体的特征,Fairy模型中,这个红点叫做查询点(query point)。物体开始移动,途中的红点会跟随其移动,这是模型将要分析的另一帧,目的是找到与查询点相对应的区域或特征,而这个几帧后的红点叫做目标帧(target frame)。所谓锚点式跨帧注意力,正是评估查询点在当前帧中的特征,并将这些特征与目标帧中的特征进行比较,以估计最佳匹配。

查询点

那么“锚点”又是指什么呢?如果放在其他模型里,锚点指的是用来参考的点。图片以及视频中的锚点,则特指用于稳定识别、追踪或定位特征的固定参考点。比如上文提到的猫鼻子,就是特定的面部特征锚点(如眼角或嘴角)。视频是有多个连续的图片组成的,在Fairy模型中,会从某一帧图片里的K个锚点帧中提取扩散特征,并将提取出的特征定义为一组全局特征,以便传播到后续帧。

在生成每个新帧时,Fairy模型用跨帧注意力替换自注意力层,这种注意力是针对锚点帧的缓存特征。通过跨帧注意力,每个帧中的token取用锚点帧中展示出相似语义内容的特征,从而增强了一致性。

Fairy通过结合跨帧注意力和对应估计,改进了扩散模型中的特征跟踪和传播方法。模型把跨帧注意力当成是一种相似性度量,以评估不同帧之间token的对应关系。这种方法使得相似的语义区域在不同帧中获得更高的注意力。通过这种注意力机制,Fairy在帧间对相似区域进行加权求和,从而细化和传播当前特征,显著减少帧间特征差异。

这也是为什么Fairy能够那么快就合成出一个新的视频,因为从技术原理上来看,它只合成了一张图片,剩下所有的内容都是这张图片连续扩散的结果。很像是一种讨巧,其实更多的像是“偷懒和投机”。人工智能和人理解世界的方式不同,它所表现出来的,就是对“最低劳动力成本”的完美诠释。

Fairy将原视频转换为新的风格

Fairy对于视频编辑行业来说,可能会带来一场革命性的变化。当下视频合成最主要的用途是制作特效,我们熟悉的特效大片每一帧都是单独制作的,因此每一帧所耗费的成本大约数百到数千美元,平均下来相当于每分钟烧掉4万美元。试想一下,一旦采用Fairy,特效大片动辄几千万几百万的特效费用,将会直接减少至几千美金,且制作周期大幅度缩短,以前需要花费几个月来渲染,以后兴许只需要几个礼拜。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier