这次Pi币真的上线主网了!

图片来源:由无界AI生成

图片来源:由无界AI生成

不久前OpenAI Sora以其惊人的视频生成效果迅速走红,在一众文生视频模型中突出重围,成为全球瞩目的焦点。

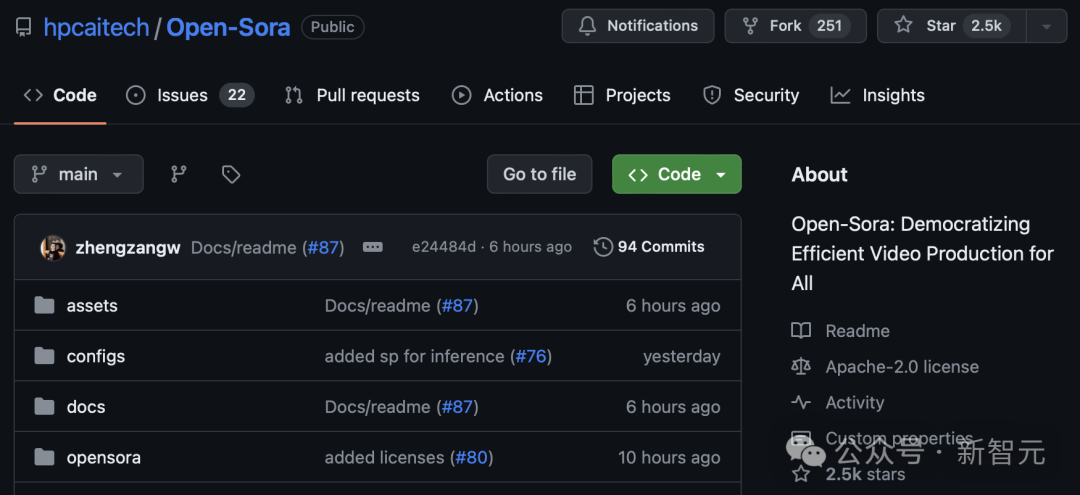

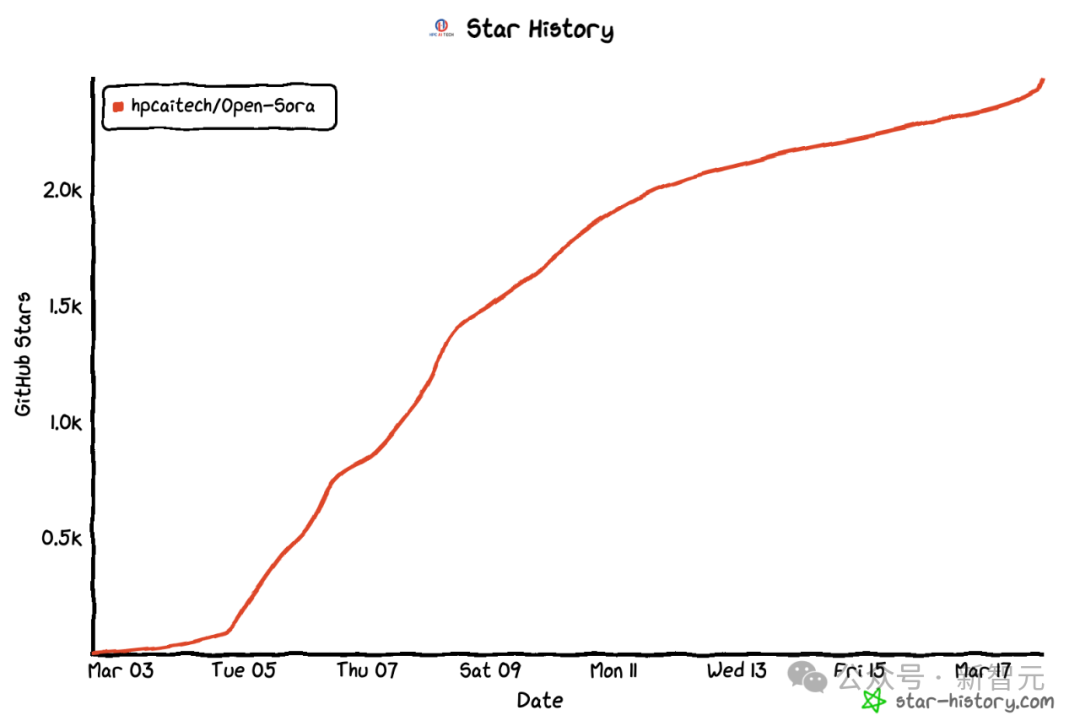

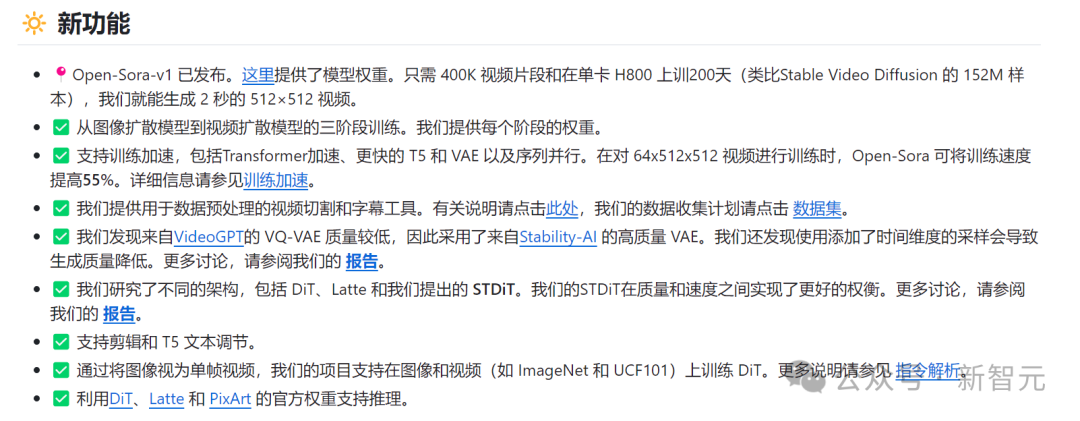

继2周前推出成本直降46%的Sora训练推理复现流程后,Colossal-AI团队全面开源全球首个类Sora架构视频生成模型「Open-Sora 1.0」——涵盖了整个训练流程,包括数据处理、所有训练细节和模型权重,携手全球AI热爱者共同推进视频创作的新纪元。

Open-Sora开源地址:https://github.com/hpcaitech/Open-Sora

先睹为快,我们先看一段由Colossal-AI团队发布的「Open-Sora 1.0」模型生成的都市繁华掠影视频。

Open-Sora 1.0生成的都市繁华掠影

这仅仅是Sora复现技术冰山的一角,关于以上文生视频的模型架构、训练好的模型权重、复现的所有训练细节、数据预处理过程、demo展示和详细的上手教程,Colossal-AI团队已经全面免费开源在GitHub。

同时,新智元第一时间联系了该团队,了解到他们将不断更新Open-Sora的相关解决方案和最新动态,感兴趣的朋友可以持续关注Open-Sora的开源社区。

全面解读Sora复现方案

接下来,我们将深入解读Sora复现方案的多个关键维度,包括模型架构设计、训练复现方案、数据预处理、模型生成效果展示以及高效训练优化策略。

模型架构设计

模型采用了目前火热的Diffusion Transformer(DiT)[1]架构。

作者团队以同样使用DiT架构的高质量开源文生图模型PixArt-α [2]为基座,在此基础上引入时间注意力层,将其扩展到了视频数据上。

具体来说,整个架构包括一个预训练好的VAE,一个文本编码器,和一个利用空间-时间注意力机制的STDiT(Spatial Temporal Diffusion Transformer)模型。

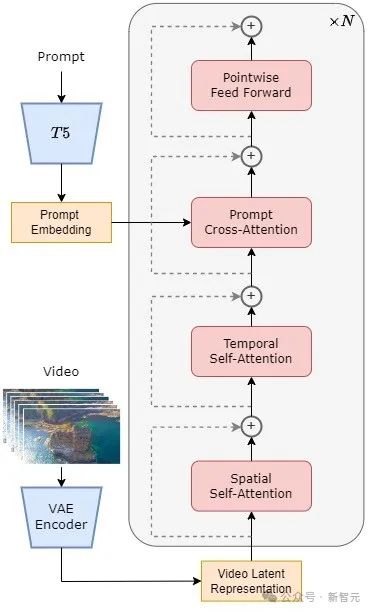

其中,STDiT 每层的结构如下图所示。它采用串行的方式在二维的空间注意力模块上叠加一维的时间注意力模块,用于建模时序关系。

在时间注意力模块之后,交叉注意力模块用于对齐文本的语意。与全注意力机制相比,这样的结构大大降低了训练和推理开销。

与同样使用空间-时间注意力机制的Latte [3]模型相比,STDiT可以更好的利用已经预训练好的图像DiT的权重,从而在视频数据上继续训练。

STDiT结构示意图

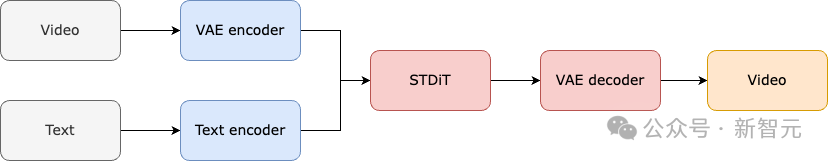

整个模型的训练和推理流程如下。据了解,在训练阶段首先采用预训练好的Variational Autoencoder(VAE)的编码器将视频数据进行压缩,然后在压缩之后的潜在空间中与文本嵌入(text embedding)一起训练STDiT扩散模型。

在推理阶段,从VAE的潜在空间中随机采样出一个高斯噪声,与提示词嵌入(prompt embedding)一起输入到STDiT中,得到去噪之后的特征,最后输入到VAE的解码器,解码得到视频。

模型的训练流程

训练复现方案

我们向该团队了解到,Open-Sora的复现方案参考了Stable Video Diffusion(SVD)[3]工作,共包括三个阶段,分别是:

1. 大规模图像预训练;

2. 大规模视频预训练;

3. 高质量视频数据微调。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier