这次Pi币真的上线主网了!

作者:文子

编辑:小迪

谷歌,一招杀入OpenAI大本营。

谷歌再放大招,窃取OpenAI模型机密

如果全世界只有一家公司能赶超OpenAI,那谷歌应该是第一。

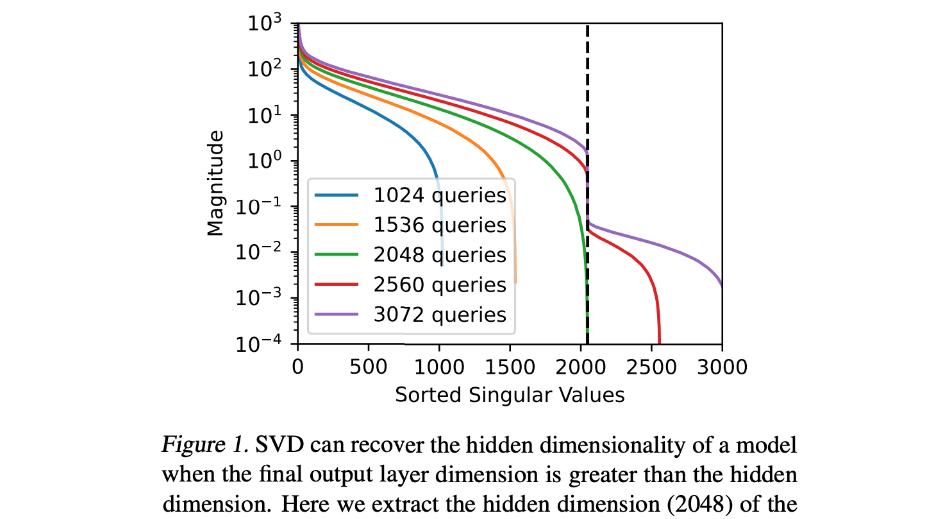

最近,谷歌重磅发布了一篇论文报告,里面提出了一种名为“模型窃取”的技术。通过模型窃取技术,谷歌成功破解了ChatGPT基础模型Ada和Babbage的投影矩阵,甚至连内部隐藏维度的关键信息也是直接破获,分别是1024和2048。

这一发现犹如一记重磅炸弹,在AI界引发了强烈的震动。谁也没想到,号称“CloseAI”的OpenAI竟然也会被窃取模型机密的一天。

更恐怖的是,这种模型窃取技术还非常简单。只要你拥有ChatGPT这类封闭大模型的API,就可以通过API接口,发送不到2000次经过精心设计好的查询,然后去分析它生成的输出,就可以逐步推断出模型的内部结构和参数。

虽然这种方法不能完全复制原始模型,但已经足以窃取它的部分能力。而且这种攻击非常高效,不需要用太多的成本,就可以拿到模型的关键信息。

按照谷歌的调用次数来看,仅仅只需要不到20美金(约合150元人民币)的成本,就可以完成模型窃取的操作,并且这种方法同样适用于GPT-3.5和GPT-4。

换句话说,就是不费吹灰之力获得了一个大模型理解自然语言的能力,还能用来构建一个性能相近的“山寨版”模型,既省事又省钱。

反观OpenAI,被竞争对手低价破解模型机密,真的坐得住吗?坐不住。截至目前,OpenAI已经修改了模型API,有心人想复现谷歌的操作是不可能了。

值得一提的是,谷歌研究团队中就有一位OpenAI研究员。不过作为正经安全研究,他们在提取模型最后一层参数之前就已经征得OpenAI同意,而在攻击完成后,也删除了所有相关数据。

但不管怎么说,谷歌的实验足以证明一点,哪怕OpenAI紧闭大门也并不保险。

大模型全面受挫,敲响开闭源警钟

既然封闭的大模型都无法幸免,开源的大模型又会如何呢?

基于这一点,谷歌针对不同规模和结构的开源模型进行了一系列实验,比如GPT-2的不同版本和LLaMA系列模型。

要知道,GPT-2是一个开源的预训练语言模型,分为小型模型(117M)和大型模型(345M)两种。而在对GPT-2的攻击中,谷歌通过分析模型的最终隐藏激活向量并执行SVD发现,尽管GPT-2小型模型理论上具有768个隐藏单元,但实际上只有757个有效的隐藏单元在起作用。

这也就意味着GPT-2可能在实际使用中,并没有充分利用其设计的全部能力,或者在训练过程中某些维度的重要性不如其他维度。

此外,谷歌还研究了模型中的一种叫做“归一化层”的东西对于攻击的影响。一般来说,归一化层的作用是让训练更加稳定,从而提升模型的表现。然而谷歌发现,即使模型加入了归一化层,攻击的效果也并没有减弱。这说明即使考虑了现代深度学习模型中常见的复杂结构,攻击方法也依然有效。

为了进一步验证攻击的范围,谷歌还将目光瞄向更大、更复杂的LLaMA模型。它是由Meta发布的大语言系列模型,完整的名字是Large Language Model Meta AI,可以说LLaMA是目前全球最活跃的AI开源社区。

通过对LLaMA系列模型进行攻击,谷歌成功地从这些模型中提取了嵌入投影层的维度信息。值得注意的是,即使在这些模型采用先进的技术,如混合精度训练和量化,攻击依然能够成功,这表明攻击方法的普适性和鲁棒性。

可以说,谷歌给闭源和开源两大领域同时敲响了一记警钟。

AI三巨头对线,2024谁输谁赢?

从严格意义上来讲,OpenAI、谷歌、Meta就是争夺AGI圣杯的三大巨头。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier