这次Pi币真的上线主网了!

引言:AI+Web3的发展

在过去的几年中,人工智能(AI)和Web3技术的快速发展引起了全球范围内的广泛关注。AI作为一种模拟和模仿人类智能的技术,已经在人脸识别、自然语言处理、机器学习等领域取得了重大突破。AI技术的快速发展为各行各业带来了巨大的变革和创新。

AI行业的市场规模在2023年达到了2000亿美元,OpenAI、Character.AI、Midjourney等行业巨头和优秀玩家如雨后春笋般涌现,引领了AI热潮。

与此同时,Web3作为一种新兴的网络模式,正在逐步改变着我们对互联网的认知和使用方式。Web3以去中心化的区块链技术为基础,通过智能合约、分布式存储和去中心化身份验证等功能,实现了数据的共享与可控、用户的自治和信任机制的建立。Web3的核心理念是将数据从中心化的权威机构手中解放出来,赋予用户对数据的控制权和数据价值的分享权。

目前Web3行业的市值达到了25万亿,无论是Bitcoin、Ethereum、Solana还是应用层的Uniswap、Stepn等玩家,新的叙事和场景也层出不穷的涌现,吸引着越来越多人加入Web3行业。

容易发现,AI与Web3的结合是东西方的builder和VC都十分关注的领域,如何将两者很好的融合是一个十分值得探索的问题。

本文将重点探讨AI+Web3的发展现状,探索这种融合所带来的潜在价值和影响。我们将首先介绍AI和Web3的基本概念和特点,然后探讨它们之间的相互关系。随后,我们将分析当前AI+Web3项目的现状,并深入讨论它们所面临的局限性和挑战。通过这样的研究,我们期望能够为投资者和相关行业的从业者提供有价值的参考和洞察。

AI与Web3交互的方式

AI和Web3的发展就像天平的两侧,AI带来了生产力的提升,而Web3带来了生产关系的变革。那么AI和Web3能碰撞出什么样的火花呢?我们接下来会先来分析AI和Web3行业各自面临的困境和提升空间,然后再探讨彼此是怎么样帮助解决这些困境。

AI行业面临的困境和潜在提升空间

Web3行业面临的困境和潜在提升空间

2.1 AI行业面临的困境

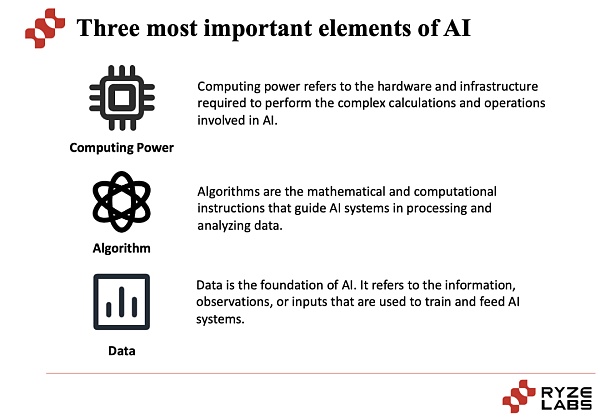

要想探究AI行业面临的困境,我们首先来看看AI行业的本质。AI行业的核心离不开三个要素:算力、算法和数据。

首先是算力:算力指的是进行大规模计算和处理的能力。AI任务通常需要处理大量的数据和进行复杂的计算,例如训练深度神经网络模型。高强度的计算能力可以加速模型训练和推理过程,提高AI系统的性能和效率。近年来,随着硬件技术的发展,如图形处理器(GPU)和专用AI芯片(如TPU),算力的提升对于AI行业的发展起到了重要的推动作用。近年股票疯涨的Nvidia就是作为GPU的提供商占据了大量的市场份额,赚取了高额的利润。

什么是算法:算法是AI系统的核心组成部分,它们是用于解决问题和实现任务的数学和统计方法。AI算法可以分为传统机器学习算法和深度学习算法,其中深度学习算法在近年来取得了重大突破。算法的选择和设计对于AI系统的性能和效果至关重要。不断改进和创新的算法可以提高AI系统的准确性、鲁棒性和泛化能力。不同的算法会有不同的效果,所以算法的提升对于完成任务的效果来说也是至关重要的。

数据为什么重要:AI系统的核心任务是通过学习和训练来提取数据中的模式和规律。

数据是训练和优化模型的基础,通过大规模的数据样本,AI系统可以学习到更准确、更智能的模型。丰富的数据集能够提供更全面、多样化的信息,使得模型可以更好地泛化到未见过的数据上,帮助AI系统更好地理解和解决现实世界的问题。

了解当前AI的核心三要素之后,让我们来看看AI在这三方面遇到的困境和挑战,首先是算力方面,AI任务通常需要大量的计算资源来进行模型训练和推理,特别是对于深度学习模型而言。然而,获取和管理大规模的算力是一个昂贵和复杂的挑战。高性能计算设备的成本、能耗和维护都是问题。尤其是对于初创企业和个人开发者来说,获得足够的算力可能是困难的。

在算法方面,尽管深度学习算法在许多领域取得了巨大的成功,但仍然存在一些困境和挑战。例如,训练深度神经网络需要大量的数据和计算资源,而且对于某些任务,模型的解释性和可解释性可能不足。此外,算法的鲁棒性和泛化能力也是一个重要问题,模型在未见过的数据上的表现可能不稳定。在众多的算法中,如何找到最好的算法提供最好的服务,是一个需要不断探索的过程。

在数据方面,数据是AI的驱动力,但获取高质量、多样化的数据仍然是一个挑战。有些领域的数据可能很难获得,例如医疗领域的敏感健康数据。此外,数据的质量、准确性和标注也是问题,不完整或有偏见的数据可能导致模型的错误行为或偏差。同时,保护数据的隐私和安全也是一个重要的考虑因素。

此外,还存在着可解释性和透明度等问题,AI模型的黑盒特性是一个公众关注的问题。对于某些应用,如金融、医疗和司法等,模型的决策过程需要可解释和可追溯,而现有的深度学习模型往往缺乏透明度。解释模型的决策过程和提供可信赖的解释仍然是一个挑战。

除此之外,很多AI项目创业的商业模式不是很清晰,这一点也让许多的AI创业者感到迷茫。

2.2 Web3行业面临的困境

而在Web3行业方面,目前也存在很多不同方面的困境需要解决,无论是对于Web3的数据分析,还是Web3产品较差的用户体验,亦或者是在智能合约代码漏洞与黑客攻击的问题,都有很多提升的空间。而AI作为提高生产力的工具,在这些方面也有很多潜在的发挥空间。

首先是数据分析与预测能力方面的提升:AI技术在数据分析和预测方面的应用为Web3行业带来了巨大的影响。通过AI算法的智能分析和挖掘,Web3平台可以从海量的数据中提取有价值的信息,并进行更准确的预测和决策。这对于去中心化金融(DeFi)领域中的风险评估、市场预测和资产管理等方面具有重要意义。

此外,也可以实现用户体验和个性化服务的改进:AI技术的应用使得Web3平台能够提供更好的用户体验和个性化服务。通过对用户数据的分析和建模,Web3平台可以为用户提供个性化的推荐、定制化的服务以及智能化的交互体验。这有助于提高用户参与度和满意度,促进Web3生态系统的发展,例如许多Web3协议接入ChatGPT等AI工具来更好的服务用户。

在安全性和隐私保护方面,AI的应用对Web3行业也具有深远的影响。AI技术可以用于检测和防御网络攻击、识别异常行为,并提供更强大的安全保障。同时,AI还可以应用于数据隐私保护,通过数据加密和隐私计算等技术,保护用户在Web3平台上的个人信息。在智能合约的审计方面,由于智能合约的编写和审计过程中可能存在漏洞和安全隐患,AI技术可以用于自动化合约审计和漏洞检测,提高合约的安全性和可靠性。

可以看出,对于Web3行业面临的困境和潜在的提升空间里,AI在很多方面都能够参与和给予助力。

AI+Web3项目现状分析

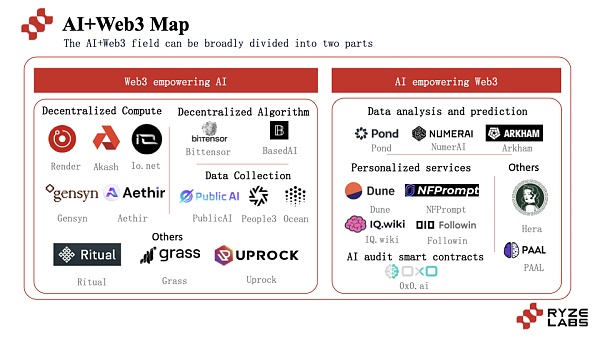

结合AI和Web3的项目主要从两个大的方面入手,利用区块链技术提升AI项目的表现,以及利用AI技术来服务于Web3项目的提升。

围绕着两个方面,涌现出了一大批项目在这条路上探索,包括Io.net、Gensyn、Ritual等各式各样的项目,接下来本文将从AI助力web3和Web3助力AI的不同子赛道分析现状和发展情况。

3.1 Web3助力AI

3.1.1 去中心化算力

从OpenAI在2022年底推出ChatGPT后,就引爆了AI的热潮,推出后5天,用户数量就达到了100万,而之前Instagram花了大约两个半月才达到100万下载量。之后,Chatgpt发力也是十分迅猛,2个月内月活用户数达到了1亿,到2023年11月,周活用户数达到了1亿。伴随着Chatgpt的问世,AI领域也迅速的从一个小众的赛道爆发成为一个备受关注的行业。

根据Trendforce的报告,ChatGPT需要30000个NVIDIA A100 GPU才能运行,而未来GPT-5将需要更多数量级的计算。这也让各个AI公司之间开启了军备竞赛,只有掌握了足够多的算力,才能够确定在AI之战中有足够的动力和优势,也因此出现了GPU短缺的现象。

在AI崛起之前,GPU的最大提供商英伟达的客户都集中在三大云服务中:AWS、Azure 和 GCP。随着人工智能的兴起,出现了大量新的买家,包括大科技公司Meta、甲骨文以及其他数据平台和人工智能初创公司,都加入了囤积 GPU 来训练人工智能模型的战争中。Meta 和特斯拉等大型科技公司大量增加了定制 AI 模型和内部研究的购买量。Anthropic 这样的基础模型公司以及 Snowflake 和 Databricks 这样的数据平台也购买了更多 GPU,来帮助客户提供人工智能服务。

正如去年Semi Analysis提到的“GPU富人和GPU穷人”,少数几家公司拥有2万多A100/p00 GPU,团队成员可以为项目使用100到1000个GPU。这些公司要么是云提供商或者是自建LLM,包括OpenAI、Google、Meta、Anthropic、Inflection、Tesla、Oracle、Mistral等。

然而大部分的公司都属于GPU穷人,只能在数量少得多的 GPU 上挣扎,花费大量的时间和精力去做较难推动生态系统发展的事情。而且这种情况并不局限于初创公司。一些最知名的人工智能公司--Hugging Face、Databricks (MosaicML)、Together 甚至 Snowflake的A100/p00 数量都小于 20K。这些公司拥有世界一流的技术人才,却受限于 GPU的供应数量,相比于大公司在人工智能中竞赛中处于劣势。

这种短缺并不局限于“GPU穷人”中,甚至在去2023年年底,AI赛道的龙头OpenAI因为无法获得足够的 GPU,不得不关闭付费注册数周,同时采购更多的 GPU 供应。

可以看出,伴随着AI高速发展带来的GPU的需求侧和供给侧出现了严重的不匹配,供不应求的问题迫在眉睫。

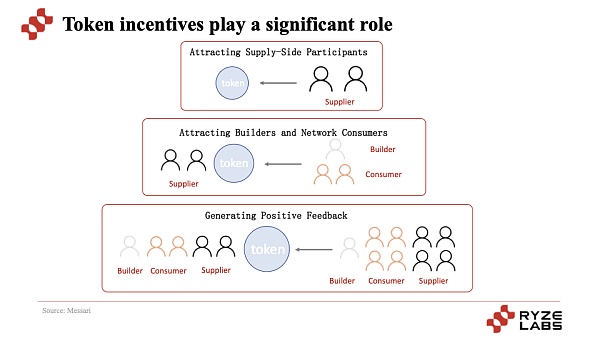

为了解决这一问题,一些Web3的项目方开始尝试结合Web3的技术特点,提供去中心化的算力服务,包括Akash、Render、Gensyn等等。这类项目的共同之处在于,通过代币来激励广大用户提供闲置的GPU算力,成为了算力的供给侧,来为AI客户提供算力的支持。

供给侧画像主要可以分为三个方面:云服务商、加密货币矿工、企业。

云服务商包括大型云服务商(如AWS、Azure、GCP)以及GPU云服务商(如Coreweave, Lambda, Crusoe等),用户可以转售闲置的云服务商的算力来获得收入。加密矿工随着以太坊从PoW转向PoS,闲置的GPU算力也成为了重要的潜在供给侧。此外,像特斯拉、Meta这类因为战略布局而购买了大量GPU的大型企业,也可以将闲置的GPU算力作为供给侧。

目前赛道的玩家大致分为两类,一类是将去中心化算力用于AI的推理,另一类是将去中心化算力用作AI训练。前者如Render(虽然聚焦在渲染,但也可用作AI算力的提供)、Akash、Aethir等;后者如io.net(推理和训练都可以支持)、Gensyn,两者最大的差异在于算力的要求不同。

先来聊聊前者AI推理的项目,这类项目通过代币激励的方式吸引用户参与算力的提供,再将算力网络服务提供给需求侧,从而实现了闲置算力的供需撮合。其中关于这类项目的介绍与分析在我们Ryze Labs之前DePIN的研报中有提到,欢迎查阅。

最核心的点在于通过代币激励机制,项目先吸引供给者,然后吸引用户使用,从而实现了项目的冷启动和核心运转机制,从而能够进一步的扩张和发展起来。在这种循环之下,供给侧有了更多更有价值的代币回报,需求侧有了更便宜性价比更高的服务,项目的代币价值和供需双方参与者的增长保持一致,随着代币价格的上升,吸引更多参与者和投机者参与,形成价值捕获。

另一类是将去中心化算力用于AI的训练,如Gensyn、io.net(AI训练和AI推理都可以支持)。其实这一类项目的运转逻辑和AI推理类项目并无太大的本质差异,依旧是通过代币激励吸引供给侧的参与提供算力,供需求侧来使用。

其中io.net作为去中心化算力网络,目前GPU数量超过了50万个,在去中心化算力项目中表现很突出,此外,目前已经也集成了Render和filecoin的算力,开始不断发展生态项目。

此外, Gensyn是通过智能合约方式可促进机器学习的任务分配和奖励,来实现AI的训练。如下图所示,Gensyn的机器学习训练工作的每小时成本约在0.4美元,而远远低于AWS和GCP超过2美元的成本。

Gensyn的体系中包括四个参与主体:提交者、执行者、验证者和举报者。

提交者:需求用户是任务的消费者,提供将被计算的任务,为AI训练任务付费

执行者:执行者执行模型训练的任务,并生成完成了任务的证明来供验证者的检查。

验证者:将非确定性训练过程与确定性线性计算联系起来,将执行者的证明与预期阈值进行比较。

举报者:检查验证者的工作,在发现问题时并提出质疑来获得收益。

可以看出,Gensyn希望成为一个面向全球深度学习模型的超大规模、经济高效的计算协议。但是纵观这个赛道,为什么大部分的项目选择去中心化算力做AI推理而不选择训练呢?

在这里也帮助不了解AI训练和推理的朋友介绍一下两者的区别:

AI训练:如果我们把人工智能比作一个学生,那么训练就类似于给人工智能提供了大量知识、示例也可以理解为我们常说的数据,人工智能从这些知识示例中进行学习。由于学习的本质需要理解和记忆大量的信息,这个过程需要大量的计算能力和时间。

AI推理:那什么是推理呢?可以理解为利用所学的知识去解决问题或者参加考试,在推理的阶段中人工智能是利用学到的知识去解答,而不是活动新知识,所以在推理过程所需要的计算量是较小的。

可以看出两者的算力需求是差别较大的,关于去中心化算力在AI推理和AI训练方面的可用性将在后面的挑战章节进行更深入的剖析。

此外,还有Ritual希望将分布式网络与模型的创建者结合,保持去中心化和安全性。其第一个产品Infernet让区块链上的智能合约可以在链下访问AI模型,允许此类合约以保持验证、去中心化和保护隐私的方式访问AI。

Infernet 的协调器负责管理节点在网络中的行为和响应消费者发出的计算请求。用户使用infernet时,推理、证明等工作会放在链下,输出结果返回至协调器,并通过合约最终传给链上的消费者。

除了去中心化算力网络之外,也有Grass这类的去中心化带宽网络,来提升数据传输的速度和效率。总的来说,去中心化算力网络的出现,为AI的算力供给侧提供了一个新的可能性,推动着AI向更远的方向前行。

3.1.2 去中心化算法模型

正如第二章中提到的,AI的三个核心要素为算力、算法和数据。既然算力可以通过去中心化的方式形成一个供给网络,那么算法是否也能有类似的思路,形成一个算法模型的供给网络呢?

在分析赛道项目之前,首先让我们一起来了解下去中心化算法模型的意义,很多人会好奇,既然已经有了OpenAI,为什么还需要去中心化的算法网络呢?

本质上,去中心化的算法网络是一个去中心化的AI算法服务市场,链接了许多不同的AI模型,每个AI模型有自己擅长的知识和技能,当用户提出问题的时候,市场会挑选出最适合回答问题的AI模型来提供答案。而Chat-GPT是OpenAI 开发的一种AI模型,可以理解和生产类似人类的文本。

简单来说,ChatGPT像是一个能力很强的学生来帮助解决不同类型的问题,而去中心化的算法网络像一个有很多学生的学校来帮助解决问题,虽然现在这个学生的能力很强,但拉长周期来看,能招募全球学生加入的学校有非常大的潜力空间。

目前在去中心化算法模型这个领域,也有一些项目在尝试和探索中,接下来将以代表性的项目Bittensor作为案例来帮助大家理解这个细分领域的发展情况。

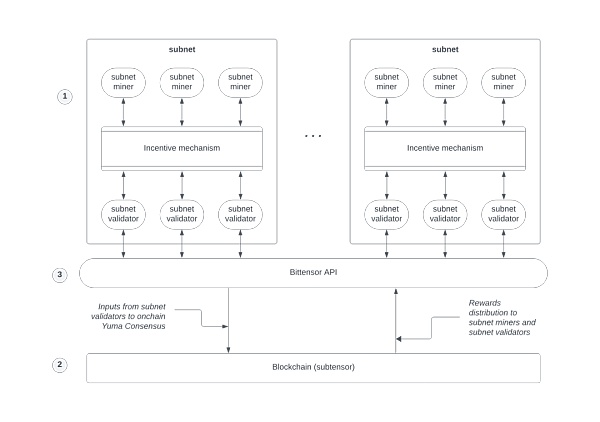

在Bittensor中,算法模型的供给侧(或者说矿工)将他们的机器学习模型贡献给网络。这些模型可以分析数据与提供见解。模型供给者会因其贡献而获得加密货币代币TAO作为奖励。

为了保证问题答案的质量,Bittensor使用独特的共识机制来确保网络就最佳答案达成一致。当提出问题时,多个模型矿工会提供答案。然后,网络中的验证器会开始工作,确定最佳答案,然后将其发送回用户。

Bittensor的代币TAO在整个流程中主要发挥两方面的作用,一方面用作激励矿工向网络贡献算法模型,另一方面用户需要花费代币来提问与让网络完成任务。

由于 Bittensor 是去中心化的,任何有互联网接入的人都可以加入网络,既可以作为提出问题的用户,也可以作为提供答案的矿工。这使得更多人能够使用强大的人工智能。

总之,以 Bittensor 等网络为例,去中心化的算法模型领域有可能创造一个更加开放、透明的局面,在这个生态系统中,人工智能模型可以以安全和分散的方式进行训练、共享和利用。此外也有像BasedAI这样的去中心化的算法模型网络在尝试类似的事情,当然其更有趣的部分在于通过ZK来保护用户与模型交互式的数据隐私,这个在第四个小节也会进一步讨论。

随着去中心化算法模型平台的发展,它们将使小型公司能够在使用顶尖AI工具方面与大型组织竞争,从而对各个行业产生潜在的重大影响。

3.1.3 去中心化数据收集

对于AI模型的训练来说,大量的数据供给是必不可少的。然而目前大部分的web2公司仍将用户的数据占为己有,例如X、Reddit、TikTok、Snapchat、Instagram、YouTube等平台禁止为人工智能训练进行数据收集。对于AI行业的发展来说成为了很大的阻碍。

然而另一方面,一些Web2平台却向AI公司出售用户的数据,而没有分享任何的利润给到用户。例如Reddit 与google达成了一项价值 6000 万美元的协议,让Google在其帖子上训练人工智能模型。从而导致数据的收集权被大资本和大数据方所霸占,导致行业超资本密集型的方向发展。

面对这样一种现状,一些项目结合Web3通过代币激励的方式,来实现去中心化的数据收集。以PublicAI为例,在PublicAI中用户可以作为两类角色参与:

一类是AI数据的提供者,用户可以在X上找到有价值的内容,@PublicAI官方并附上见解,使用#AI或#Web3作为分类标签,便可以将内容发送到PublicAI数据中心,实现数据收集。

另一类是数据验证者,用户可以登录PublicAI数据中心,为AI训练选择最有价值的数据进行投票。

作为回报,用户可以通过这两类贡献获得代币激励,从而促进了数据的贡献者与人工智能产业开发之间的携手共赢的关系。

除了PublicAI这类专门收集数据进行AI训练的项目之外,还有很多项目也在通过通过代币激励进行去中心化的数据收集,例如Ocean通过数据代币化的方式收集用户数据来服务于AI,Hivemapper通过用户的车载摄像头来收集地图数据、Dimo收集用户的汽车数据、WiHi收集天气数据等等,这类通过去中心化收集数据的项目,也都是潜在的AI训练的供给侧,所以从广义来说,也可以纳入到Web3助力AI的范式中。

3.1.4 ZK保护AI中的用户隐私

区块链技术带来的除了去中心化的优势之外,还有一个很重要的就是零知识证明。通过零知识技术,可以保护隐私的同时实现信息的验证。

而在传统的机器学习中,数据通常需要集中存储和处理,这可能导致数据隐私泄露的风险。另一方面,保护数据隐私的方法,如数据加密或数据去识别化,可能会限制机器学习模型的准确性和性能。

而零知识证明的技术正好能帮助面对这一困境,来解决隐私保护和数据共享之间的冲突。

ZKML(Zero-Knowledge Machine Learning)通过使用零知识证明技术,允许在不泄露原始数据的情况下进行机器学习模型的训练和推理。零知识证明使得数据的特征和模型的结果可以被证明为正确,而无需揭示实际的数据内容。

ZKML的核心目标是实现隐私保护和数据共享的平衡。它可以应用于各种场景,如医疗健康数据分析、金融数据分析和跨组织合作等。通过使用ZKML,个体可以保护其敏感数据的隐私,同时与他人共享数据以获得更广泛的洞见和合作的机会,而无需担心数据隐私泄露的风险。

目前该领域仍处于早期阶段,大部分的项目仍在探索中,例如BasedAI 提出了一种去中心化的方法,将 FHE 与 LLM 无缝集成,以保持数据机密性。利用零知识大型语言模型 (ZK-LLM) 将隐私嵌入其分布式网络基础设施的核心,确保用户数据在整个网络运行过程中保持私密。

这里简单解释下什么是全同态加密(FHE)。全同态加密是一种加密技术,可以在加密状态下对数据进行计算,而无需解密。这意味着在使用FHE加密的数据上执行的各种数学运算(如加法、乘法等)可以在保持数据的加密状态下进行,并获得与在原始未加密数据上执行相同运算所得到的结果,从而保护用户数据的隐私。

此外,除了上述四类之外,在Web3助力AI方面,也有像Cortex这样支持在链上执行AI程序的区块链项目。目前,在传统区块链上执行机器学习程序面临一个挑战,虚拟机在运行任何非复杂的机器学习模型时效率极低。因此,大多数人认为在区块链上运行人工智能是不可能的。而Cortex虚拟机(CVM)利用 GPU,可以在链上执行 AI 程序,并且与 EVM 兼容。换句话说,Cortex 链可以执行所有以太坊 Dapp,并在此基础上将AI机器学习融入这些 Dapp。从而实现了以去中心化、不可变和透明的方式运行机器学习模型,因为网络共识会验证人工智能推理的每一步。

3.2 AI助力web3

在AI和Web3的碰撞中,除了Web3对AI的助力之外,AI对于Web3行业的助力也十分值得关注。人工智能的核心贡献在于生产力的提升,因此在AI审计智能合约、数据分析与预测、个性化服务、安全和隐私保护等方面都有许多尝试。

3.2.1 数据分析与预测

目前很多Web3项目开始集成现有的AI服务(例如ChatGPT)或者自研来为Web3用户提供数据分析和预测类的服务。涵盖面非常广,包括通过AI算法提供投资策略、链上分析AI工具、价格与市场预测等等。

例如Pond通过AI图算法来预测未来的有价值的alpha token,为用户和机构提供投资辅助建议;还有BullBear AI 根据用户的历史数据和价格线历史以及市场走势进行训练,以提供最准确的信息来支持预测价格走势,来帮助用户获得收益和利润。

还有Numerai这类的投资竞赛平台,参赛者基于AI与大语言模型等来预测股票市场,利用平台提供免费的高质量数据训练模型,并每天提交预测。Numerai 会计算这些预测在接下来一个月中的表现,参赛者可以将 NMR 押注在模型上,根据模型的表现获得收益。

此外,还有Arkham这类链上数据分析平台也结合AI进行服务。Arkham将区块链地址与交易所、基金和巨鲸等实体联系起来,并向用户展示这些实体的关键数据和分析,为用户提供决策优势。其与AI结合的部分在于Arkham Ultra通过算法将地址与现实世界的实体进行匹配,由Arkham核心贡献者在Palantir和OpenAI创始人的支持下历时3年开发而成。

3.2.2 个性化服务

在Web2的项目中,AI在搜索和推荐领域都有很多的应用场景,服务于用户的个性化需求。在Web3项目中也是如此,不少项目方通过集成AI的方式来优化用户的使用体验。

例如大家比较熟知的数据分析平台Dune,最近新推出了Wand工具,用于借助大型语言模型编写 SQL 查询。通过 Wand Create功能,用户可以根据自然语言问题自动生成 SQL 查询,从而使不懂SQL的用户也可以非常方便的进行搜索。

此外,还有一些Web3的内容平台也开始集成ChatGPT进行内容总结,例如Web3媒体平台Followin集成了ChatGPT来总结某一赛道的观点和最新近况;Web3百科全书平台IQ.wiki致力于成为网络上区块链技术和加密货币有关的一切客观、高质量知识的主要来源,让区块链在全球范围内更容易被发现和获取,并为用户提供他们可以信赖的信息,其也集成了GPT-4来总结wiki文章;以及基于LLM的搜索引擎的Kaito致力于成为Web3搜索平台,改变 Web3 的信息获取方式。

在创作方面,也有像NFPrompt这样减少用户创作成本的项目。NFPrompt让用户可以通过AI来更容易的生成NFT,从而降低了用户的创作成本,在创作方面提供了许多个性化的服务。

3.2.3 AI审计智能合约

在Web3领域中,智能合约的审计也是一个非常重要的工作,通过AI去实现智能合约代码的审计,可以更加高效准确的识别和找出代码中的漏洞。

正如Vitalik曾提到,加密货币领域面临的一个最大挑战是我们代码中的错误。而一个令人期待的可能性是,人工智能(AI)能够显著简化使用形式验证工具来证明满足特定属性的代码集。如果能够做到这一点,我们有可能拥有无错误的SEK EVM(例如以太坊虚拟机)。减少错误的数量越多,空间的安全性就会增加,而AI对于实现这一点来说非常有帮助。

例如0x0.ai项目提供了人工智能智能合约审计器,是一种使用先进算法分析智能合约并识别可能导致欺诈或其他安全风险的潜在漏洞或问题的工具。审计员使用机器学习技术识别代码中的模式和异常,标记出潜在问题,以便进一步审查。

除了上述三类之外,还有一些利用AI来助力Web3领域的原生案例,例如PAAL帮助用户创建个性化AI Bot,可以部署到Telegram和Discord上来服务于Web3的用户;AI驱动的多链dex聚合器Hera,利用AI来提供最广泛的代币以及任何代币对之间的最佳交易路径,整体来说,AI助力Web3更多的是作为工具层面的助力。

AI+Web3项目的局限性和挑战现状

4.1 去中心化算力方面存在的现实阻碍

目前的Web3助力AI的项目中,很大一部分都在发力于去中心化算力,通过代币激励的方式来促进全球的用户都能成为算力供给侧是一个非常有趣的创新,不过另一方面,也面临着一些现实的问题需要解决:

相比中心化算力服务提供商,去中心化算力产品通常依赖于分布在全球的节点和参与者提供计算资源。由于这些节点之间的网络连接可能存在延迟和不稳定性,因此性能和稳定性可能较中心化算力产品差。

此外,去中心化算力产品的可用性受到供应和需求之间的匹配程度的影响。如果没有足够的供应者或者需求过高,可能会导致资源不足或者无法满足用户需求。

最后,相比中心化算力产品,去中心化算力产品通常涉及更多的技术细节和复杂性。用户可能需要了解并处理分布式网络、智能合约和加密货币支付等方面的知识,用户理解和使用的成本会变高。

和大量的去中心化算力项目方深入探讨后发现,目前的去中心化算力基本还是只能局限在AI推理而不是AI训练。

接下来我将以四个小问题来帮助大家理解背后的原因:

1、为什么大部分去中心化算力项目都选择做AI推理而不是AI训练?

2、英伟达究竟牛在哪里?去中心化算力训练难做的原因在哪?

3、去中心化算力(Render、Akash、io.net等)的终局会是什么样?

4、去中心化算法(Bittensor)的终局会是什么样?

接下来咱们层层抽丝剥茧:

1)纵观这个赛道,大部分的去中心化算力项目都选择做AI推理而不是训练,核心在于对于算力和带宽的要求不同。

为了帮助大家的更好地理解,我们来把AI比作一个学生:

AI训练:如果我们把人工智能比作一个学生,那么训练就类似于给人工智能提供了大量知识、示例也可以理解为我们常说的数据,人工智能从这些知识示例中进行学习。由于学习的本质需要理解和记忆大量的信息,这个过程需要大量的计算能力和时间。

AI推理:那什么是推理呢?可以理解为利用所学的知识去解决问题或者参加考试,在推理的阶段中人工智能是利用学到的知识去解答,而不是活动新知识,所以在推理过程所需要的计算量是较小的。

容易发现,两者的难度差本质上在于大模型AI训练需要极大的数据量,以及对数据高速通信需要的带宽需求极高,所以目前去中心化算力用作训练的实现难度极大。而推理对于数据和带宽的需求小的多,实现可能性更大。

对于大模型来说,最重要的是稳定性,如果训练中断,需要重新训练,沉没成本很高。另一方面,对于算力要求相对较低的需求是可以实现的,例如上文提到的AI推理,或者是一些特定场景的垂类中小型的模型训练是有可能实现的,在去中心化算力网络中有一些相对大的节点服务商,可以为这些相对大的算力需求服务。

2)那么数据和带宽的卡点究竟在哪?为什么去中心化训练难以实现?

这就涉及到大模型训练的两个关键要素:单卡算力和多卡并联。

单卡算力:目前所有的需要训练大模型的中心,我们把它叫做超算中心。为了方便大家的理解,我们可以以人体作为比喻,超算中心就是人体的组织,底层单元GPU就是细胞。如果单个细胞(GPU)的算力很强,那么整体的算力(单个细胞×数量)也可能会很强。

多卡并联:而一个大模型的训练动辄就是千亿GB,对于训练大模型的超算中心来说,至少需要万级别个A100打底。所以就需要调动这几万张卡来进行训练,然而大模型的训练并不是简单的串联,并不是在第一个A100卡上训练完之后再在第二张卡上训练,而是模型的不同部分,在不同的显卡上训练,训练A的时候可能需要B的结果,所以涉及到多卡并行。

为什么英伟达这么厉害,市值一路腾飞,而AMD和国内的华为、地平线目前很难追上。核心并不是单卡算力本身,而是在于两个方面:CUDA软件环境和NVLink多卡通信。

一方面,有没有软件生态能适配硬件是非常重要的,如英伟达的CUDA系统,而构建一个新的系统是很难的,就像构建了一个新的语言,替换成本非常高。

另一方面,就是多卡通信,本质上多卡之间的传输就是信息的输入和输出,怎么并联,怎么传输。因为NVLink的存在,没有办法把英伟达和AMD卡打通;另外,NVLink会限制显卡之间的物理距离,需要显卡在同一个超算中心中,这就导致去中心化的算力如果分布在世界各地就比较难实现。

第一点解释了为什么AMD和国内的华为、地平线目前很难追上;第二点解释了为什么去中心化训练很难实现。

3)去中心化算力的终局会是什么样?

去中心化算力目前难以进行大模型训练,核心在于大模型训练最看重的是稳定性,如果训练中断,需要重新训练,沉没成本很高。其对于多卡并联的要求是很高的,而带宽是受物理距离的限制的。英伟达通过NVLink来实现多卡通信,然而在一个超算中心里面,NVLink会限制显卡之间的物理距离,因此分散的算力无法形成一个算力集群去进行大模型训练。

但另一方面,对于算力要求相对较低的需求是可以实现的,例如AI推理,或者是一些特定场景的垂类中小型的模型训练是有可能实现的,在去中心化算力网络中有一些相对大的节点服务商时,是有潜力为这些相对大的算力需求服务的。以及像渲染这类边缘计算的场景也是相对容易实现的。

4)去中心化算法模型的终局会是什么样?

去中心化算法模型的终局取决于对未来AI的终局,我认为未来AI之战可能会是有1-2个闭源模型巨头(如ChatGPT),再加上百花齐放的模型,在这种背景下,应用层产品没有必要和一个大模型绑定,而是与多个大模型合作,在这种背景下来看,Bittensor的这种模式潜力还是非常大的。

4.2 AI+Web3的结合较为粗糙,没有实现1+1>2

目前在Web3与AI结合的项目中,尤其是AI助力Web3项目方面,大多数项目仍然只是表面上使用AI,没有真正体现出AI与加密货币之间的深度结合。这种表面化的应用主要体现在以下两个方面:

首先,无论是利用AI进行数据分析和预测,还是在推荐和搜索场景中使用AI,或者是进行代码审计,与Web2项目和AI的结合并没有太大的区别。这些项目仅仅是简单地利用AI提升效率和进行分析,没有展现出AI与加密货币之间的原生融合和创新性解决方案。

其次,许多Web3团队与AI的结合更多地是在营销层面上纯粹利用AI的概念。他们只是在非常有限的领域运用了AI技术,然后开始宣传AI的趋势,营造出一种项目与AI很紧密的假象。然而,在真正的创新方面,这些项目还存在很大的空白。

尽管当前的Web3与AI项目还存在这些局限性,但我们应该意识到这仅仅是发展的早期阶段。未来,我们可以期待更加深入的研究和创新,以实现AI与加密货币之间更紧密的结合,并在金融、去中心化自治组织、预测市场和NFT等领域创造出更原生且有意义的解决方案。

4.3 代币经济学成为AI项目叙事的缓冲之剂

正如一开始提到的AI项目的商业模式难题,由于越来越多大模型开始逐渐开源,目前大量的AI+Web3的项目很多时候是纯AI项目难以在Web2发展和融资,于是选择叠加Web3的叙事和代币经济学来促进用户的参与。

但真正关键的是代币经济学的融入是否真正有助于AI项目解决实际需求,还是单纯的叙事或者走短期价值,其实是需要打一个问号的。

目前大部分的AI+Web3项目还远远没有到实用的阶段,希望能有更多踏实有想法的团队能够不仅仅将token作为AI项目的一个造势,而是真正地满足实际的需求场景。

总结

当前,AI+Web3的项目已经涌现出许多案例和应用。首先,AI技术可以为Web3提供更高效、智能的应用场景。通过AI的数据分析和预测能力,可以帮助Web3的用户在投资决策等场景中拥有更好的工具;此外,AI还可以审计智能合约代码,优化智能合约的执行过程,提高区块链的性能和效率。同时,AI技术还可以为去中心化应用提供更精确、智能的推荐和个性化服务,提升用户体验。

与此同时,Web3的去中心化和可编程性特点也为AI技术的发展提供了新的机遇。通过代币激励的方式,去中心化算力的项目为AI算力供不应求的困境提供了新的解决方案,Web3的智能合约和分布式存储机制也为AI算法的共享和训练提供了更广阔的空间和资源。Web3的用户自治和信任机制也为AI的发展带来了新的可能性,用户可以自主选择参与数据共享和训练,从而提高数据的多样性和质量,进一步改善AI模型的性能和准确度。

尽管目前的AI+Web3的交叉项目仍处于早期,有许多困境需要面对,但其也带来了很多优势。例如去中心化算力产品存在一些缺点,但降低了对中心化机构的依赖、提供了更大的透明度和可审计性,以及能够实现更广泛的参与和创新。对于特定的使用案例和用户需求,去中心化算力产品可能是一个有价值的选择;在数据收集方面也是如此,去中心化数据收集项目也带来了一些优势,如减少单一数据源的依赖、提供更广泛的数据覆盖范围以及促进数据的多样性和包容性等。在实践中,需要权衡这些优缺点,并采取相应的管理和技术措施来克服挑战,以确保去中心化数据收集项目对AI的发展产生积极的影响。

总的来说,AI+Web3的融合为未来的科技创新和经济发展提供了无限的可能性。通过将AI的智能分析和决策能力与Web3的去中心化和用户自治相结合,相信未来可以构建更智能、更开放、更公正的经济乃至社会系统。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier