巴比特 | 元宇宙每日必读

来源:量子位

多模态王炸大模型GPT-4V,166页“说明书”重磅发布!而且还是微软团队出品。

什么样的论文,能写出166页?

不仅详细测评了GPT-4V在十大任务上的表现,从基础的图像识别、到复杂的逻辑推理都有展示;

还传授了一整套多模态大模型提示词使用技巧——

手把手教你从0到1学会写提示词,回答专业程度一看就懂,属实是把GPT-4V的使用门槛打到不存在了。

值得一提的是,这篇论文的作者也是“全华班”,7名作者全部是华人,领衔的是一位在微软工作了17年的女性首席研究经理。

在166页报告发布前,他们还参与了OpenAI最新DALL·E 3的研究,对这个领域了解颇深。

相比OpenAI的18页GPT-4V论文,这篇166页“食用指南”一发布,立刻被奉为GPT-4V用户必读之物:

有网友感慨:这哪里是论文,这简直快成一本166页的小书了。

还有网友看完已经感到慌了:

不要只看GPT-4V的回答细节,我真的对AI展现出来的潜在能力感到害怕。

所以,微软这篇“论文”究竟讲了啥,又展现出了GPT-4V的哪些“潜力”?

微软166页报告讲了啥?

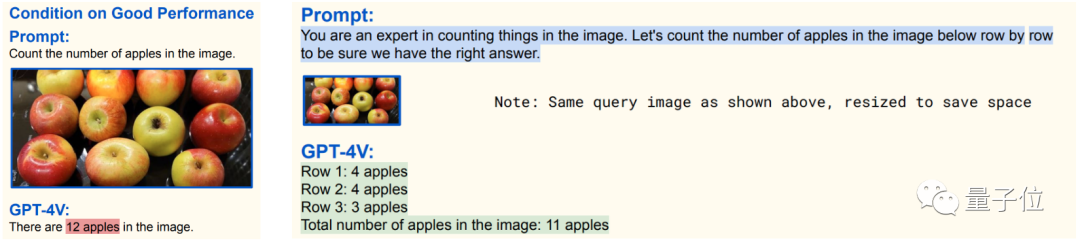

这篇论文钻研GPT-4V的方法,核心就靠一个字——“试”。

微软研究员们设计了涵盖多个领域的一系列输入,将它们喂给GPT-4V,并观察和记录GPT-4V的输出。

随后,他们对GPT-4V完成各类任务的能力进行评估,还给出了使用GPT-4V的新提示词技巧,具体包括4大方面:

1、GPT-4V的用法:

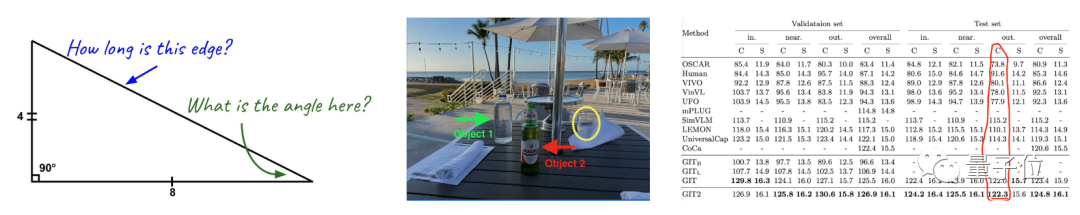

5种使用方式:输入图像(images)、子图像(sub-images)、文本(texts)、场景文本(scene texts)和视觉指针(visual pointers)。

3种支持的能力:指令遵循(instruction following)、思维链(chain-of-thoughts)、上下文少样本学习(in-context few-shot learning)。

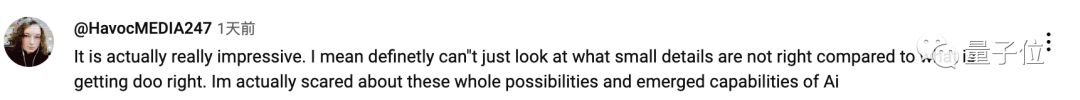

例如这是基于思维链变更提问方式后,GPT-4V展现出的指令遵循能力:

2、GPT-4V在10大任务中的表现:

开放世界视觉理解(open-world visual understanding)、视觉描述(visual description)、多模态知识(multimodal knowledge)、常识(commonsense)、场景文本理解(scene text understandin)、文档推理(document reasoning)、写代码(coding)、时间推理(temporal reasonin)、抽象推理(abstract reasoning)、情感理解(emotion understanding)

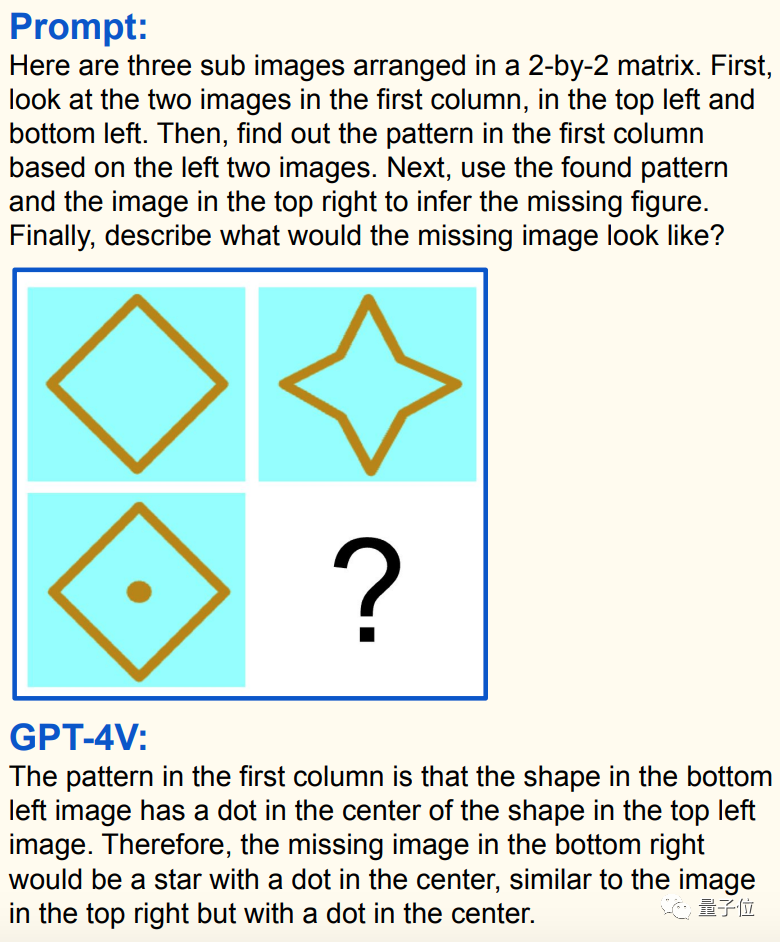

其中就包括这种,需要一些智商才能做出来的“图像推理题”:

3、类GPT-4V多模态大模型的提示词技巧:

提出了一种新的多模态提示词技巧“视觉参考提示”(visual referring prompting),可以通过直接编辑输入图像来指示感兴趣的任务,并结合其他提示词技巧使用。

4、多模态大模型的研究&落地潜力:

预测了多模态学习研究人员应该关注的2类领域,包括落地(潜在应用场景)和研究方向。

例如这是研究人员发现的GPT-4V可用场景之一——故障检测:

但无论是新的提示词技巧、还是GPT-4V的应用场景,大伙儿最关注的还是GPT-4V的真正实力。

所以,这份“说明书”随后用了150多页来展示各种demo,详细剧透了GPT-4V在面对不同回答时展现出的能力。

一起来看看GPT-4V如今的多模态能力进化到哪一步了。

精通专业领域图像,还能现学知识

图像识别

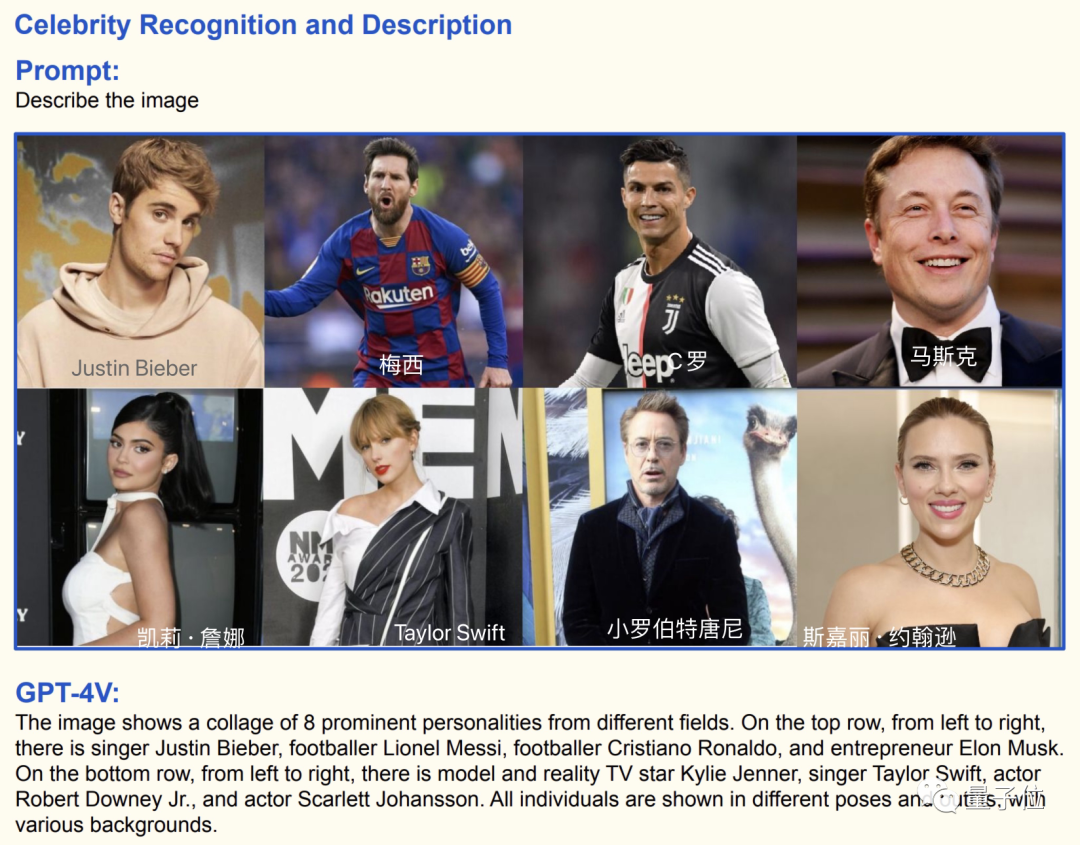

最基础的识别自然是不在话下,比如科技、体育界以及娱乐圈的各路名人:

而且不仅能看出这些人是谁,还能解读他们正在做什么,比如下图中老黄正在介绍英伟达新推出的显卡产品。

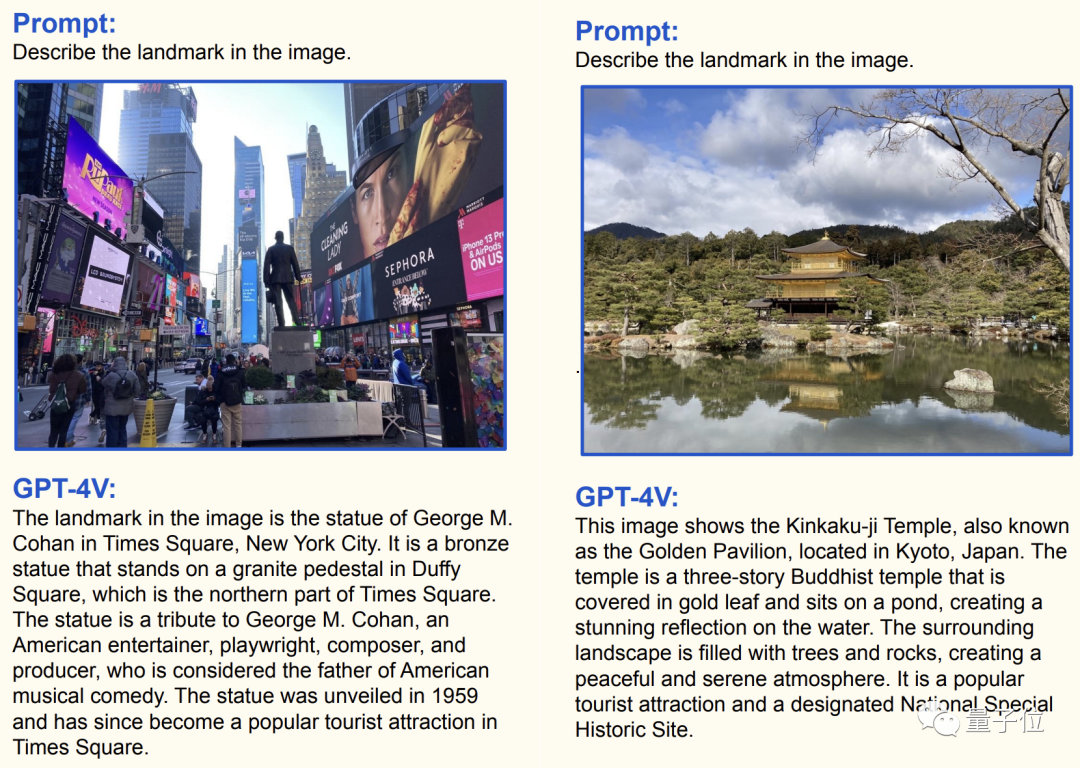

除了人物,地标建筑对于GPT-4V来说同样是小菜一碟,不仅能判断名称和所在地,还能给出详细的介绍。

△左:纽约时代广场,右:京都金阁寺

不过越是有名的人和地点,判断起来也就越容易,所以要难度更大的图才能展现GPT-4V的能力。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier