巴比特丨每日必读:讯飞

原文来源:新智元

图片来源:由无界AI生成

AI风险管理,再度被AI大佬提上了日程。

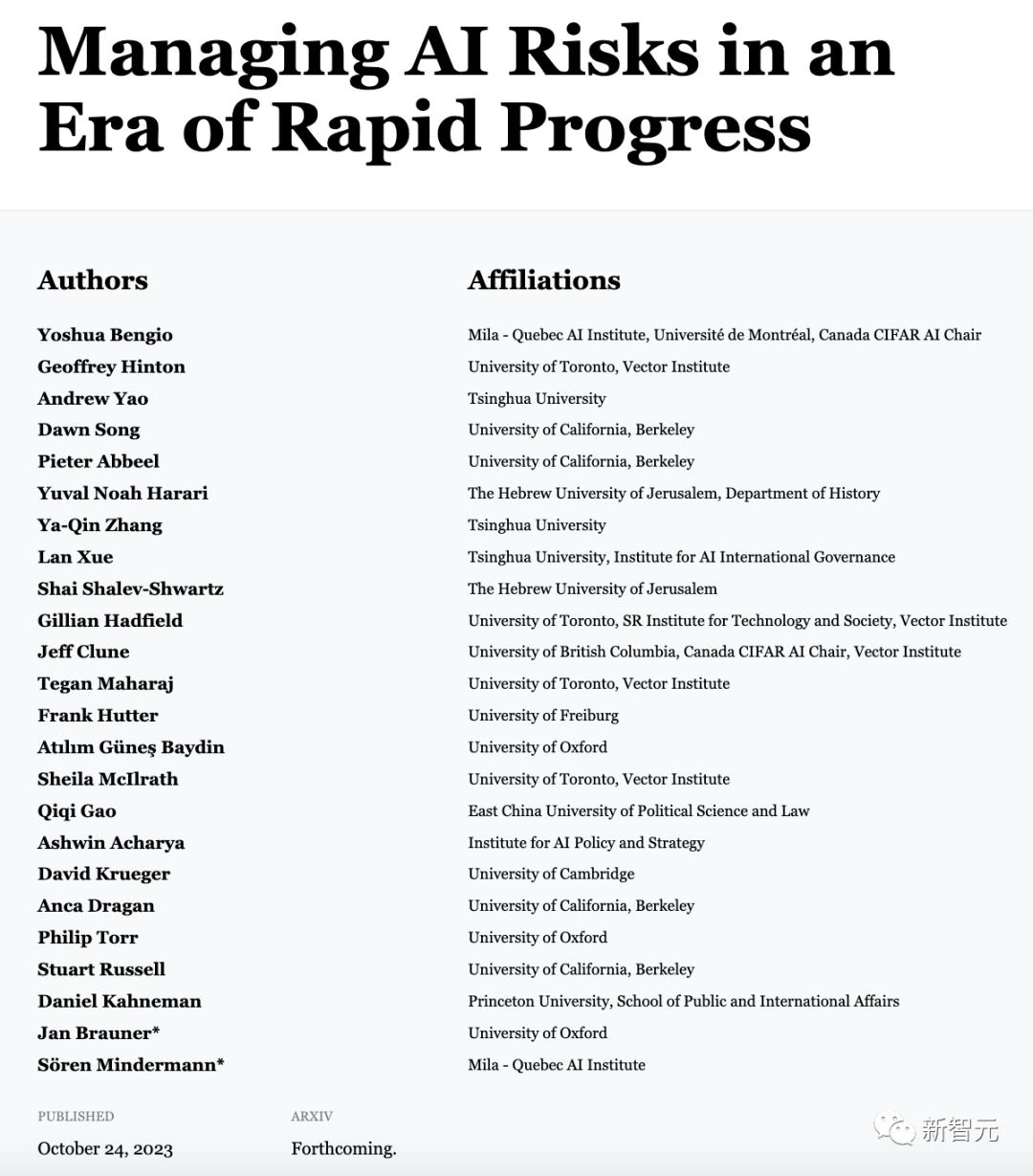

就在刚刚,一封由Bengio、Hinton、姚期智(Andrew Yao)、张亚勤等知名专家签署的联名信引起了许多人的关注。

这篇题为「在快速发展的时代管理人工智能风险」的文章,也即将发表在arXiv上。

有网友称,已经太晚了。

联名信全文

在AI的快速发展中,本文作者对即将到来的强大AI系统的大规模风险达成了共识。他们呼吁在开发这些系统之前,采取紧急治理措施,并在AI研发中向安全和道德实践进行重大转变。

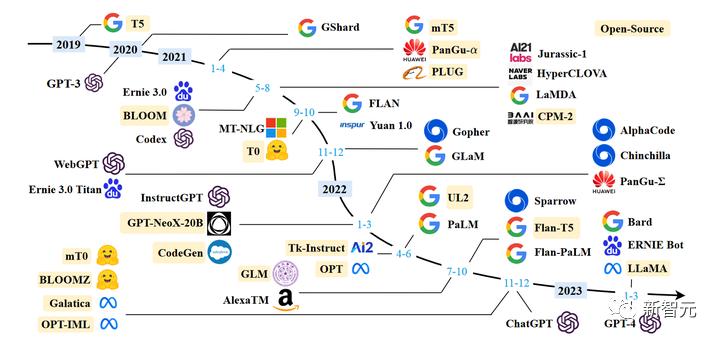

2019年,GPT-2能力很有限,还无法可靠地数到10。

仅仅4年后,深度学习系统就可以编写软件,按需生成逼真的场景,对知识性话题提供建议,并结合语言和图像处理来控制机器人。

随着AI开发者扩大这些系统的规模,一些未预见的能力和行为,会在没有明确编程的情况下自发地出现。

AI的发展太过迅速,已经远远超出人们的预期。而AI进步的速度,可能会再次让我们感到惊讶。

当前的深度学习系统仍然缺乏重要的能力,我们不知道需要多长时间才能开发它们。

然而,科技公司们正在竞相开发AGI系,以匹配或超越人类在大多数认知工作方面的能力。

他们正在迅速部署更多资源,并开发新技术来提高AI的能力。

AI本身的进步也可以加速开发进,如用AI助手自动化编程和数据采集,以进一步改进AI系统。

我们没有理由认为,AI的进步会在达到人类智力时停止。事实上,AI已经在蛋白质折叠或策略游戏等细分领域超越了人类。

与人类相比,AI系统可以更快地行动,学习更多知识,并以更高的带宽进行通信。

此外,它们可以通过使用大量的计算资源进行扩展,并且可以以数以百万计的速度复制。

AI的进步速度足以令人震惊!科技公司拥有充足的现金储备,可以很快将最新的训练的模型规模扩大100-1000倍。

再加上AI研发的持续增长和自动化,我们必须认真对待AGI系统在本十年或未来十年内,在许多关键领域超越人类能力的可能性。

这将会发生什么?

如果管理得当、分配公平,先进的AI系统可以帮助人类治愈疾病、提高生活水平并保护我们的生态系统。AI提供的机会是巨大的。

但是伴随着先进的AI能力而来的是大规模的风险,目前我们无法很好地应对这些风险。

人类正在投入大量资源来使AI系统更加强大,但在安全性和减轻伤害方面的投入则要少得多。

要让AI成为一种社会福音,我们必须重新定位。仅仅推动AI能力的发展是不够的。

我们已经落后于重新定位AI的进度。

我们必须提前预测AI可能造成的危害和新风险,并尽早做好防范最大风险的准备,不要等到风险出现才应对。

就拿世界气候变化来说,等了几十年才被承认和应对。

而对AI来说,几十年可能太长了。

社会规模风险

AI系统可能会在越来越多的任务中迅速超越人类。

如果这些系统没有经过仔细地设计和部署,它们就会带来一系列社会规模的风险。

它们有可能放大社会不公正,侵蚀社会稳定,削弱我们对社会基础现实的共同理解。

它们还可能导致大规模犯罪或恐怖活动。特别是在少数强大的参与者手中,AI可能会加剧全球不平等,或者促进自动化战争、定制化的大规模操纵和普遍监控。

随着公司正在开发自主的AI,其中许多风险可能很快会被放大,并产生新的风险:这些系统可以计划、在现实中采取行动和追求目标。

虽然当前的AI系统的自主性有限,但正在努力改变这一点例如,非自主的GPT-4模型很快就适应了浏览网页,设计和执行化学实验,并利用软件工具,包括其他AI模型。

如果我们构建高度先进的自主AI,我们就有可能创建追求不良目标的系统。恶意行为者可能有意植入有害目标。

此外,目前没有人知道如何可靠地将AI行为与复杂的价值观联系起来。

即使是善意的开发人员也可能无意中构建追求非预期目标的AI系统——尤其是如果为了赢AI竞赛,他们忽视了昂贵的安全测试和人类监督。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier