理解货币贬值:比特币没

作者 | 山竹

出品 | 锌产业

图片来源:由无界AI生成

图片来源:由无界AI生成

我是在出差途中看到关于苹果MM1消息的,当时并没有觉得惊讶,毕竟苹果放弃造车、转战生成式AI的消息早已不是秘密。让我感到惊讶的是,最懂苹果的彭博社记者Mark Gurman爆料称,苹果正在和谷歌洽谈“将Gemini植入iPhone事宜”。如果Gemini最终真出现在了今年9月即将发布的iPhone 16上,那就意味着,MacBook好不容易摆脱了英特尔的噩梦,iPhone却又着了谷歌的道。即便只是暂时联姻,但Android阵营的大模型渗透到苹果系统中,这也堪称是前无古人了。话虽如此,但我们还是有必要了解一下苹果对于生成式AI的态度转变,以及关于下一代AI iPhone的猜想。

01

MM1的战略意图

就在上周,苹果团队产出了一篇关于多模态预训练大模型的论文,苹果名为MM1的多模态预训练大模型在这篇论文中也浮出水面。

MM1,大多数果粉听起来都会觉得这名字耳熟得很。

无论苹果是有意还是无意,这名字确实容易让人想起苹果MacBook搭载的第一代基于ARM架构自研的处理器M1,也是凭借M1,苹果最终摆脱了英特尔多年的噩梦,真正实现了绝对的软硬一体。

苹果将自己的大模型命名为MM1,似乎也有想要摆脱现在市面上几乎一手遮天的OpenAI影响的寓意。

每篇研究论文,关键之处在于独创性,这也就是所谓的研究成果。

苹果公司这篇名为MM1的论文,虽然没有透露出太多公司战略层面的想法,但是也输出了一些苹果AI研究团队的认知:

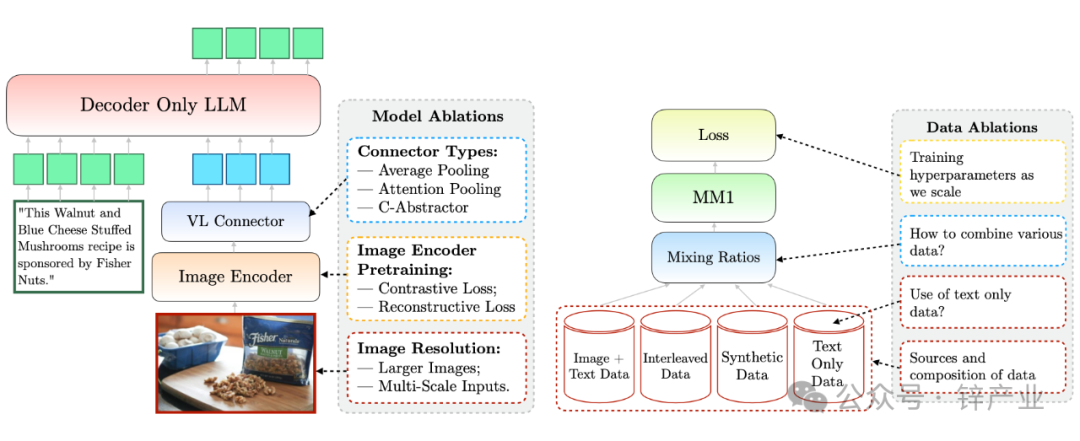

例如,苹果AI研究团队在论文中指出,对于多模态预训练大模型而言,使用图像字幕、图像文本交错内容、纯文本内容的组合对于在多个基准测试中实现少量优秀测试结果至关重要。

苹果AI研究团队在论文中还指出,在模型设计过程中,相关要素的重要性依次为:图像分辨率(image resolution)、视觉编码器的损耗和容量(visual encoder loss and capacity)、视觉编码器预训练数据(visual encoder pre-training data)。

苹果MM1大模型,则是基于LLM(大语言模型)+MoE(混合专家系统)搭建而成的多模态大模型,参数规模有3B、7B、30B三个版本。

实际上,MM1更像是苹果在放弃造车后,一次不那么正式地对外官宣,官宣自己确实已经在将大模型作为研发重心来对待。

早在2023年ChatGPT火遍全球时,Mark Gurman就曾爆料,苹果这年2月在乔布斯剧院举办了一场人工智能年度峰会。大模型和AI工具,正是这场仅允许苹果内部员工参与的活动的主要议题。随后,《纽约时报》报道称,尽管Siri存在设计缺陷已经毋庸置疑,但苹果工程师已经在开发类似ChatGPT的人工智能。不过,这个五年前在苹果内部成立,由苹果人工智能负责人John Giannandrea领导的16人团队,彼时的研究方向还是对话式AI基础模型。直到去年,一个名为“Ajax”的大模型框架,以及一个被苹果内部员工称为“Apple GPT”的聊天机器人项目再次浮出水面,关于苹果大模型的消息才有了些苗头。而这些无论是被称作对话式AI,还是大模型的项目,主要目标就是改善Siri、搜索、地图、Apple Music在内的软件体验。

这样的商业导向,让苹果人工智能团队一直有着充足的预算,彭博社在2023年10月的一份报道中指出,苹果每年在人工智能技术开发上的预算高达10亿美元。只不过,虽然Siri这两年已经正在变得好用,但由于苹果的战略摇摆,让它没能在百模大战中崭露头角。MM1的悄然上线,算是苹果在放弃汽车、选定生成式AI这样的业务调整后,一个战略意图上的显露。

02

谷歌的GPT外衣

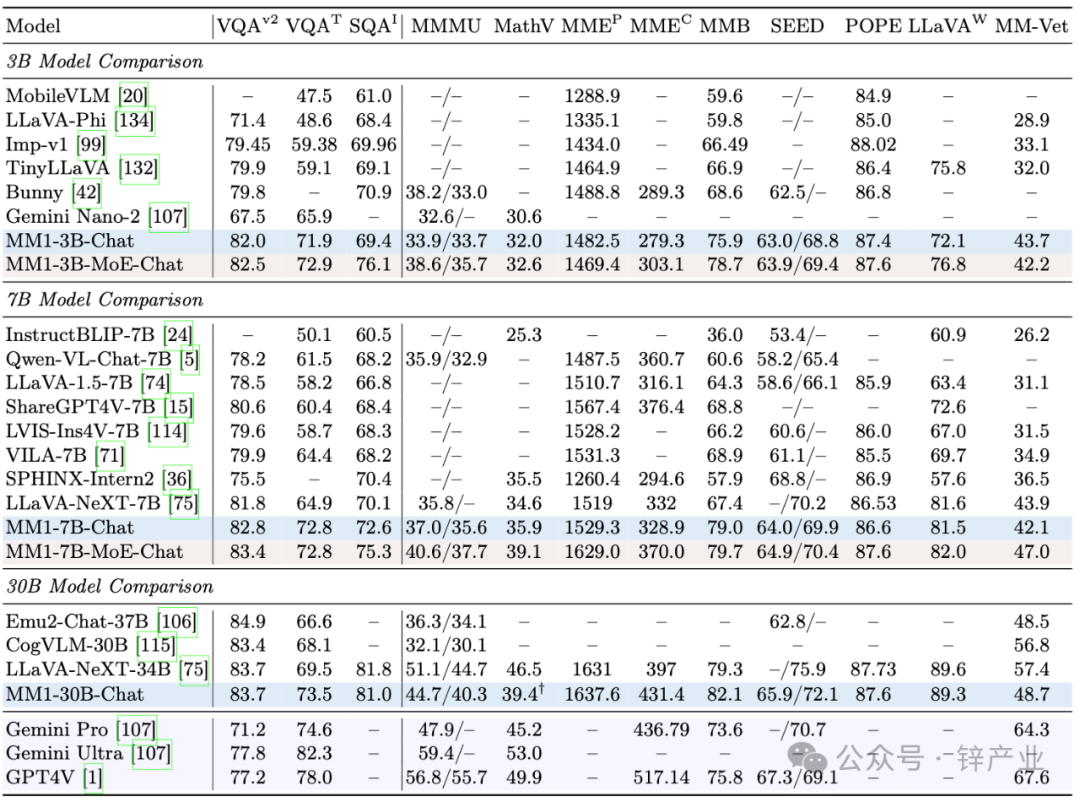

从苹果AI研究团队这篇论文的测试报告中可以看到,和OpenAI、谷歌的多模态大模型相比,苹果的MM1并不占优势,甚至可以用差强人意来形容。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier