DeepMind指出「Transformer无法

原文来源:新智元

图片来源:由无界 AI生成

人类距离第一个AGI的出现已经越来越近了!

DeepMind联合创始人,首席AGI科学家Shane Legg在不久前的访谈中认为,2028年,人类有50%的概率开发出第一个AGI。

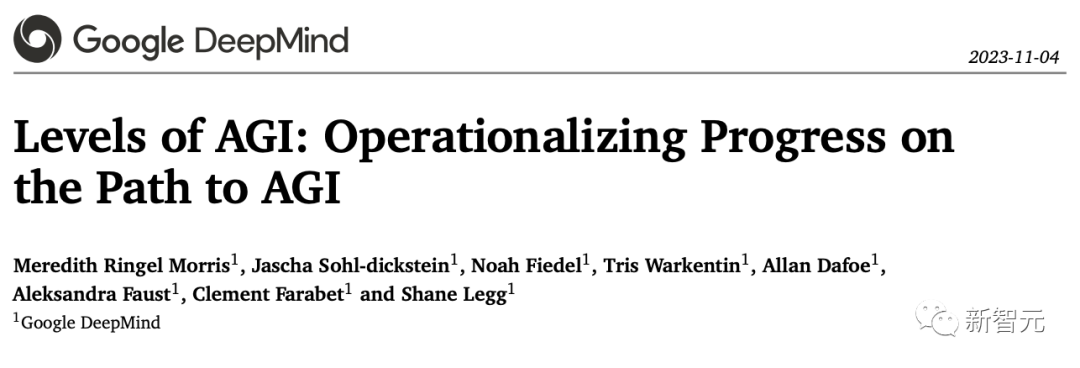

而就在今天,他带领的DeepMind研究团队在Arxiv上公布了一篇论文,直接放出了AGI的路线图和时间表。

论文地址:https://arxiv.org/abs/2311.02462

虽然论文主题感觉很大很空,但是网友认为文章很好的定义了AGI,避免了以后各种鸡同鸭讲的讨论。

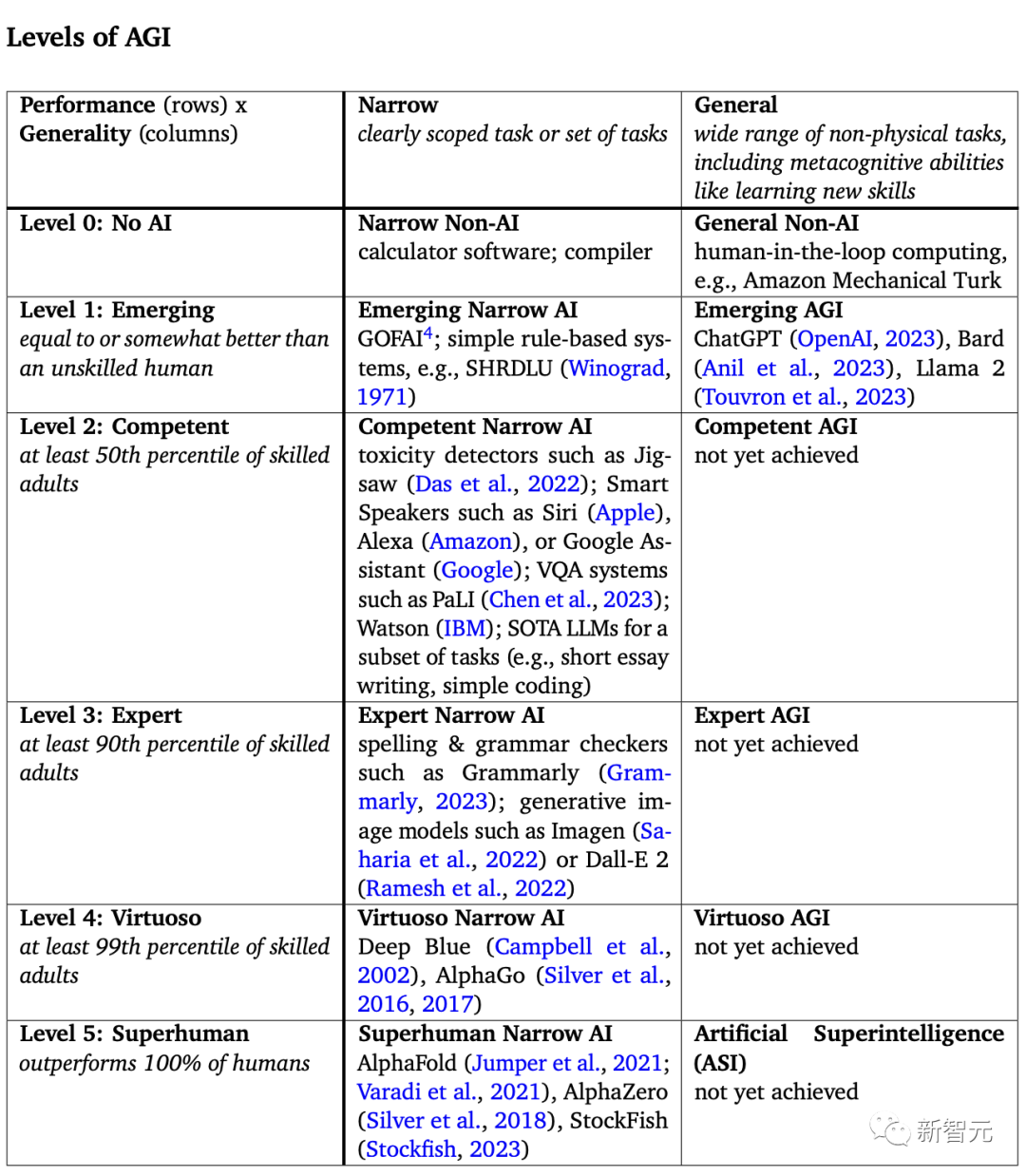

研究团队认为,从性能强度和通用性两个维度,可以将人类和AI的关系划分为5个阶段,而现在大语言模型的出现,正属于第一个通用AI的阶段:AGI雏形。

以OpenAI的ChatGPT,谷歌Bard,Meta的Llama为代表的大模型,已经在通用性上展示出了AGI的潜力。

因为大语言模型已经能完成范围相当广的各类任务,而且表现出了像学习新技能这样的「元认知」能力。

而如果单从AI的性能维度上看,「窄AI(Narrow AI)」类型的AI已经达到了完全超越人类认知的水平。

以AlphaFold,AlphaZero为代表的专业领域AI,在特定领域已经能发现人类智力无法发现的新事物了。研究团队将其称为「超人类窄AI」。

而和人类相比,在某个领域达到99%的人类的水平,比如在棋类竞技中能够战胜人类顶尖大师的「深蓝」和AlphaGo,就属于这一类。研究团队将它们称为「大师级窄AI」。

而在某些领域,AI能达到90%的人类水平,比如文书纠正AI Grammarly,DALL·E 2,Imagen等生图AI。研究团队将其称为「专家级窄AI」。

在特定领域,能达到普通人的平均水平,比如Siri,谷歌助手这类普通智能助理。研究团队将其称为「普通窄AI」。

而在这四个窄AI已经覆盖的能力维度上,通用AI都还没有出现对应的实例。

而进一步,因为目前还没有出现真正意义上的AGI,对于AGI的定义,人类还没有达到统一的认知。

所以论文中还提供了定义AGI的6个准则:

在论文的最后一个部分,作者还提出了对于未来可能出现的AGI的测评与风险评估问题。

在作者看来,需要考虑人类与AGI的互动模式,仅看模型能力来评估AGI是非常片面的。

具体来说,AGI的能力不同于AGI的自主性。随着AGI能力的增强,会解锁更高级的人机互动模式,但不意味着就必须给予AGI最大的自主性。

在这个技术之上,作者提出了6种人机互动模式:无AI、AI工具、AI顾问、AI协作者、AI专家、AI智能体。

不同的人机互动模式需要不同的AGI能力作为前提,比如AI智能体可能需要AI能力达到专家或者超人类AI级别,才能更好地完成这个互动模式处理的任务。

人机互动模式本身会引入不同类型的风险。例如AI智能体具有最高的自主性,但同时也引入了最大风险。

因此,AGI的风险评估需要同时考虑模型能力和人机互动模式。合理的互动模式选择有助于AGI系统的负责任部署。

人机互动研究需要与模型能力提升保持同步,以支持对AGI系统的安全且有效的利用。

AGI,黎明还是黄昏?

从1955年达特茅斯人工智能会议开始 ,人类就朝着实现「真正的智能」这颗北极星曲折前进,途中也经过了不同的道路。

AGI的概念与对人工智能进步的预测有关,它正在朝着更大的普遍性发展,接近并超越人类的普遍性。

此外,AGI通常与「涌现」一词交织在一起,有能力实现开发人员未明确预期的功能。这种能力使新型互动或新行业成为可能。

AGI可能产生重大的经济影响——我们是否达到了广泛劳动力替代的必要标准?

AGI还可能带来与经济优势有关的地缘政治以及军事上的影响。

同样,我们也应该通过评估AGI的水平来预防她带来的风险。

正如一些人推测的那样,AGI系统可能能够欺骗和操纵、积累资源、推进目标、代理行为,并递归地自我改进,最终在广泛的领域中取代人类。

所以,对于人工智能研究界来说,明确反思我们所说的「AGI」的含义,并量化人工智能系统的性能、通用性和自主性等属性至关重要。

我们必须理解自己在AGI道路上所处的位置。

AGI案例分析

首先,我们应当考虑如何正确定义AGI,也许可以从一些案例中获得启发。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier