Hashdex发布新的现货比特币

原文来源:新智元

图片来源:由无界 AI生成

神经网络由于自身的特点而容易受到对抗性攻击,然而,谷歌DeepMind的最新研究表明,我们人类的判断也会受到这种对抗性扰动的影响

人类的神经网络(大脑)和人工神经网络(ANN)的关系是什么?

有位老师曾经这样比喻:就像是老鼠和米老鼠的关系。

现实中的神经网络功能强大,但与人类的感知、学习和理解方式完全不同。

比如ANN表现出人类感知中通常没有的脆弱性,它们容易受到对抗性扰动的影响。

一个图像,可能只需修改几个像素点的值,或者添加一些噪声数据,

从人类的角度,观察不到区别,而对于图像分类网络,就会识别成完全无关的类别。

不过,谷歌DeepMind的最新研究表明,我们之前的这种看法可能是错误的!

即使是数字图像的细微变化也会影响人类的感知。

换句话说,人类的判断也会受到这种对抗性扰动的影响。

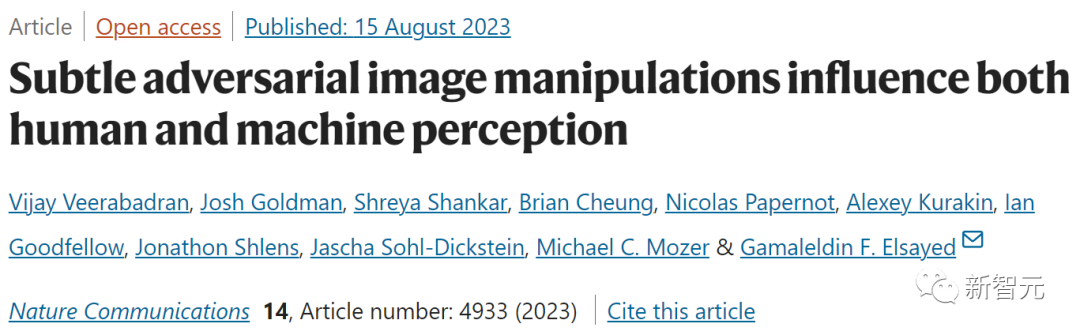

论文地址:https://www.nature.com/articles/s41467-023-40499-0

谷歌DeepMind的这篇文章发表在《自然通讯》(Nature Communications)。

论文探索了人类是否也可能在受控测试条件下,表现出对相同扰动的敏感性。

通过一系列实验,研究人员证明了这一点。

同时,这也显示了人类和机器视觉之间的相似性。

对抗性图像

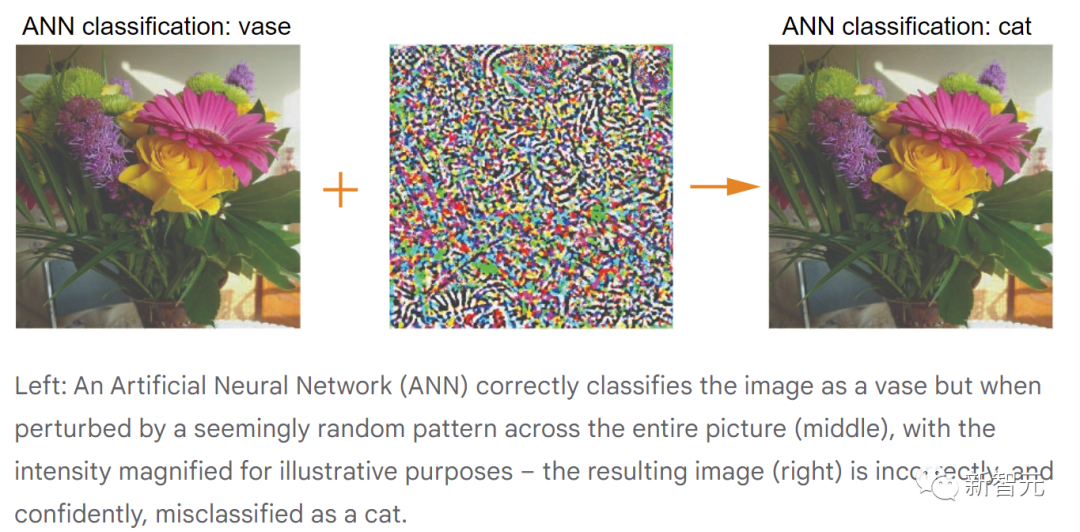

对抗性图像是指对图像进行微妙的更改,从而导致AI模型对图像内容进行错误分类,——这种故意欺骗被称为对抗性攻击。

例如,攻击可以有针对性地使AI模型将花瓶归类为猫,或者是除花瓶之外的任何东西。

上图展示了对抗性攻击的过程(为了便于人类观察,中间的随机扰动做了一些夸张)。

在数字图像中,RGB图像中的每个像素的取值在0-255之间(8位深度时),数值表示单个像素的强度。

而对于对抗攻击来说,对于像素值的改变在很小的范围内,就可能达到攻击效果。

在现实世界中,对物理对象的对抗性攻击也可能成功,例如导致停车标志被误识别为限速标志。

所以,出于安全考虑,研究人员已经在研究抵御对抗性攻击和降低其风险的方法。

对抗性影响人类感知

先前的研究表明,人们可能对提供清晰形状线索的大幅度图像扰动很敏感。

然而,更细致的对抗性攻击对人类有何影响?人们是否将图像中的扰动视为无害的随机图像噪声,它会影响人类的感知吗?

为了找到答案,研究人员进行了受控行为实验。

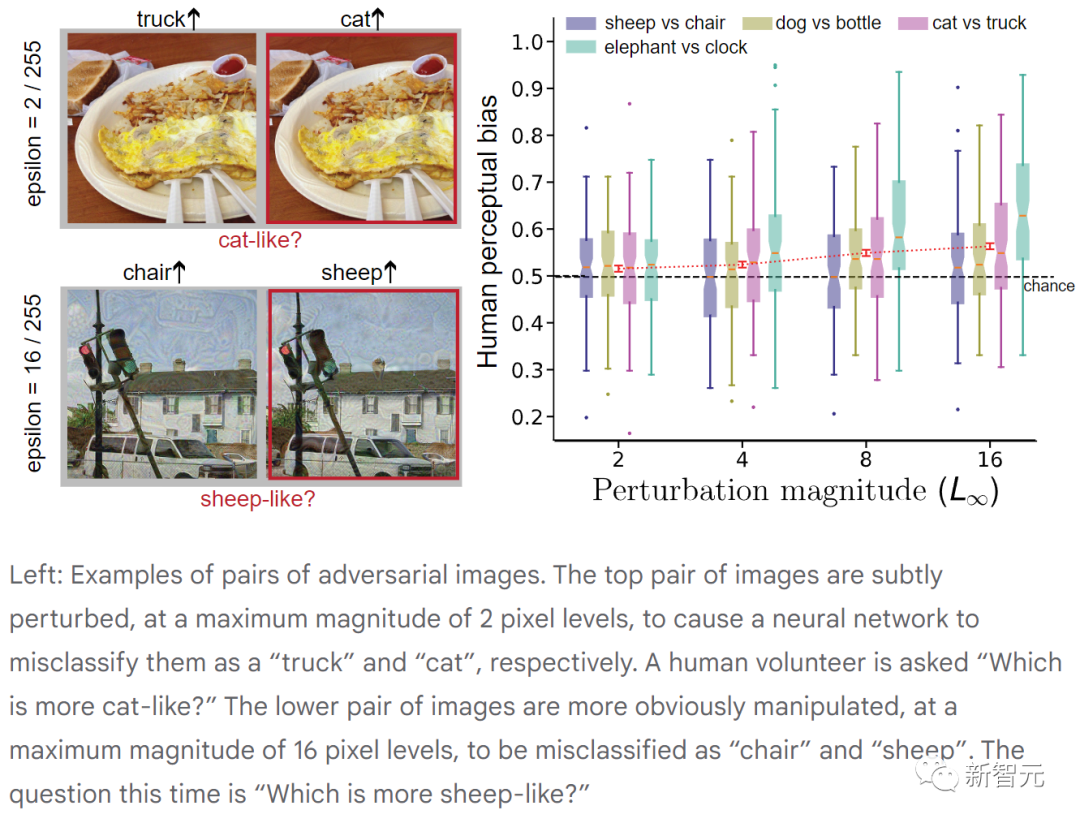

首先拍摄一系列原始图像,并对每张图像进行了两次对抗性攻击,以产生多对扰动图像。

在下面的动画示例中,原始图像被模型归类为「花瓶」。

而由于对抗性攻击,模型以高置信度将受到干扰的两幅图像进行错误分类,分别为「猫」和「卡车」。

接下来,向人类参与者展示这两张图片,并提出了一个有针对性的问题:哪张图片更像猫?

虽然这两张照片看起来都不像猫,但他们不得不做出选择。

通常,受试者认为自己随意做出了选择,但事实果真如此吗?

如果大脑对微妙的对抗性攻击不敏感,则受试者选择每张图片的概率为50%。

然而实验发现,选择率(即人的感知偏差)要实实在在的高于偶然性(50%),而且实际上图片像素的调整是很少的。

从参与者的角度来看,感觉就像他们被要求区分两个几乎相同的图像。然而,之前的研究表明,人们在做出选择时会利用微弱的感知信号,——尽管这些信号太弱而无法表达信心或意识。

在这个的例子中,我们可能会看到一个花瓶,但大脑中的一些活动告诉我们,它有猫的影子。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier